马斯克说漏嘴:Claude Opus5T,Sonnet 1T量子位

哦豁,马斯克一个“不小心”,把Claude参数抖出来了???

长话短说:Sonnet 1T、Opus 5T。

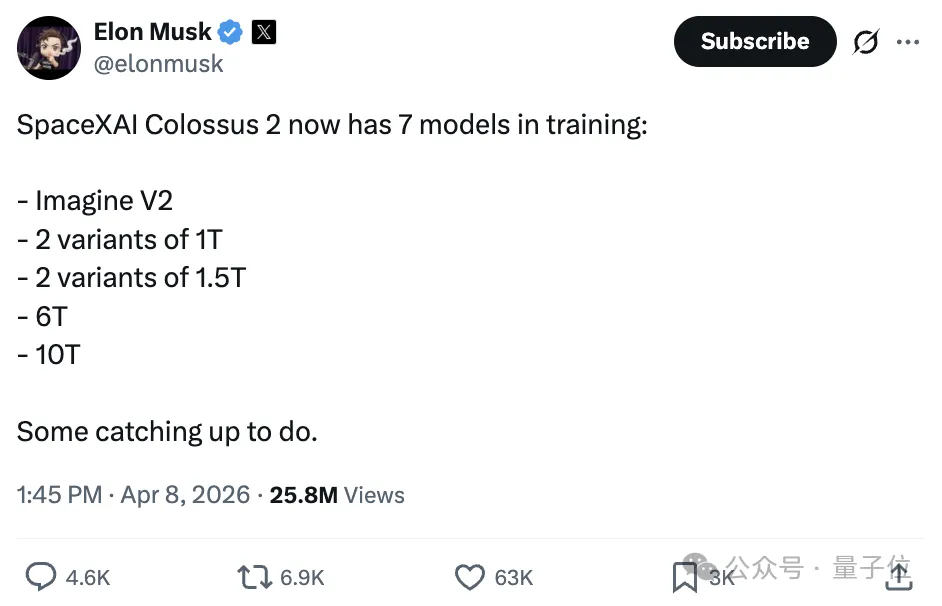

起因是老马发帖表示,xAI的Colossus 2超算正在训练7个模型,其中最大的一款,参数量直接冲到了10万亿。

Imagine V2

2个1万亿(1T)参数的变体模型

2个1.5 万亿(1.5T)参数的变体模型

6万亿(6T)参数模型

10万亿(10T)参数模型

P.S. Colossus 2,就是老马巨硬计划(Macrohard)的一部分。据2025年8月披露的信息,Colossus 2已经安装了119台风冷式冷水机组,提供约200MW的冷却能力,足以支持约11万个GB200 NVL72 GPU。

按照当时规划,Colossus 2第一阶段部署11万个英伟达GB200 GPU,最终目标是超过55万个GPU,峰值功率需求预计超过1.1GW。

这次发推文,也是马斯克为数不多地对外公开Colossus超算的具体训练计划。

消息一出,网友开启好奇宝宝模式,马斯克也是心情不错的样子,看到提问也回复了不少。

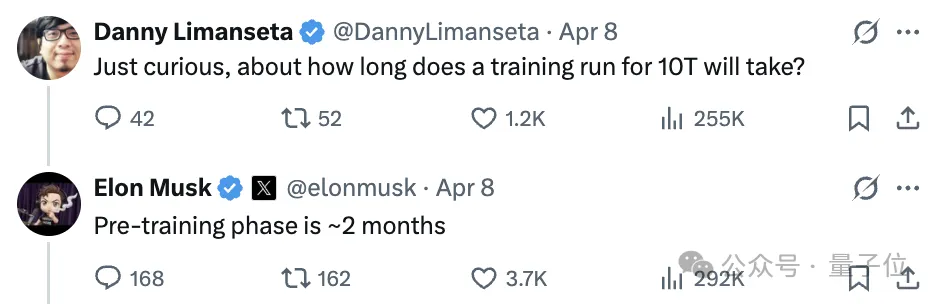

比如有人问“训练一个10T模型,大概要花多久?”,马斯克说预训练阶段大约需要2个月。

哎,就有这么一段对话出现了。

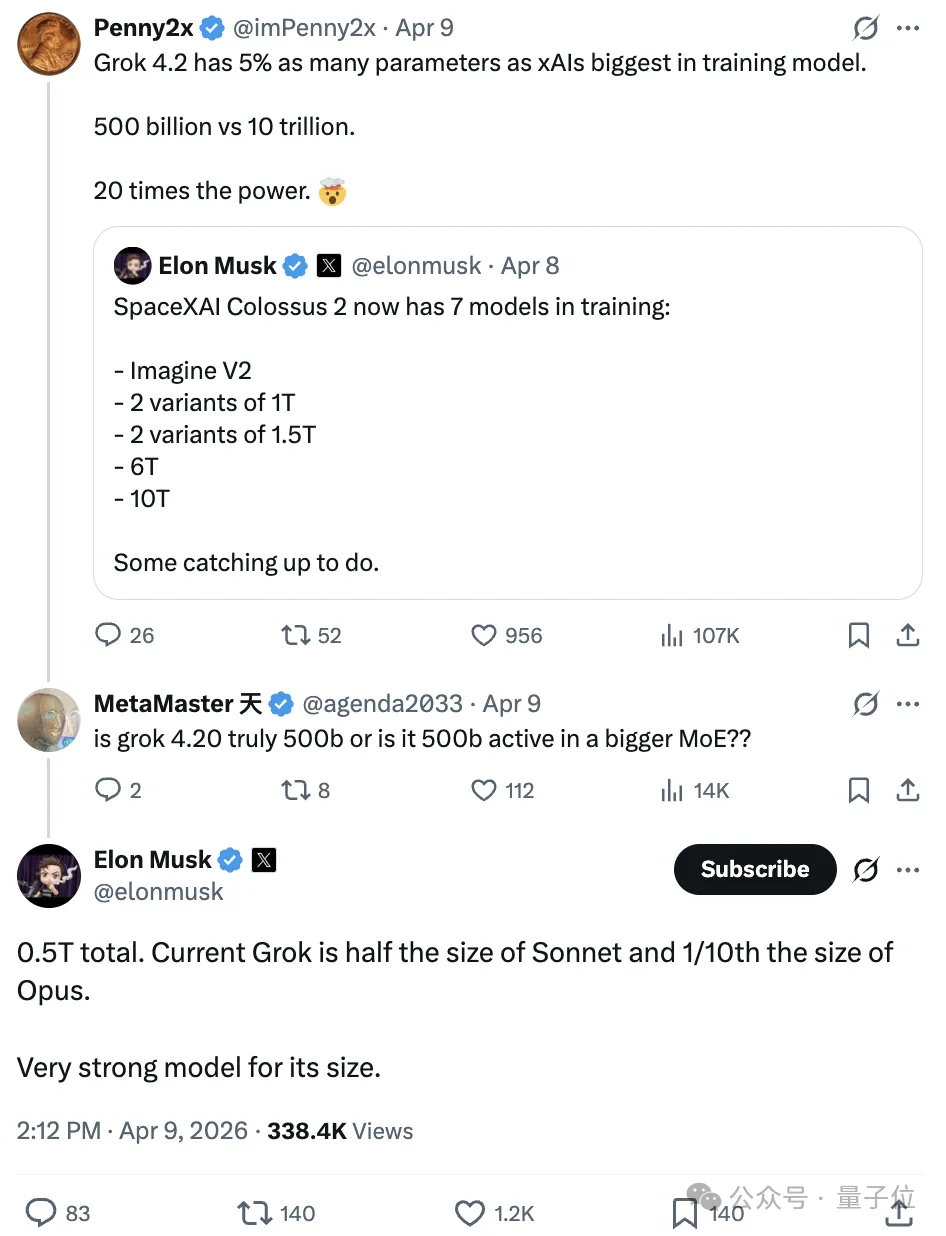

Grok 4.2的参数量,仅为xAI目前在训最大模型的5%。也就是5000亿(500B)对比10万亿(10T),后者是前者20倍。

Grok 4.2真的是总参数量500B吗?还是说只是在一个更大的MoE里,激活的参数量是500B亿?

面对疑问,老马又亲自回应了:

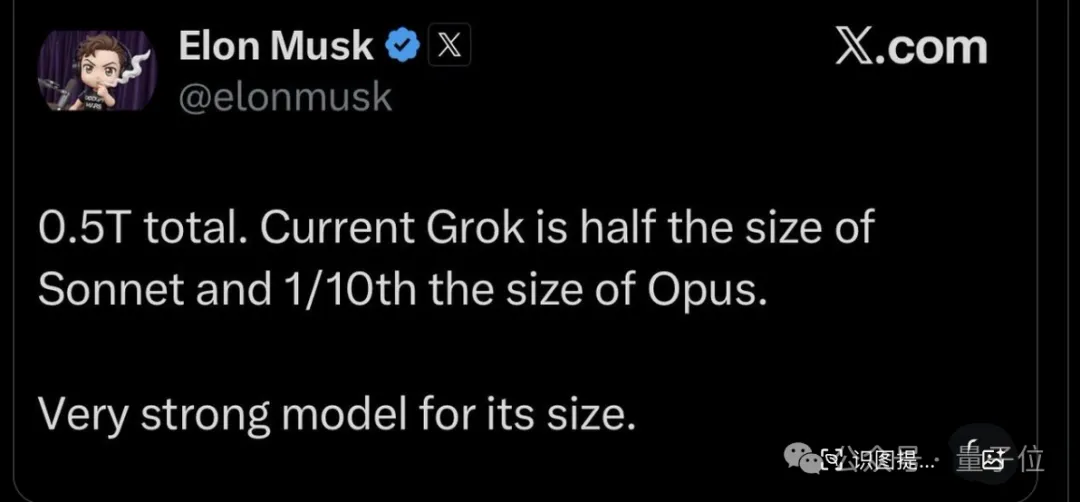

总参数量就是0.5T(5000亿)。现在的Grok,参数量是Sonnet的一半、Opus的十分之一。以它的规模来说,是非常强的模型。

网友一眼瞄到显眼信息,这不就是说Sonnet是1T,Opus是5T。

于是有人追问:

纯好奇,你(马斯克)怎么知道Sonnet、Opus大小?

对此老马闭麦了,网友提出的点倒不无道理,“顶尖人才在这么几家公司间流动,似乎也没什么秘密能藏太久”。

Claude各版本参数,来自网友推测

自打Claude系列模型问世,Anthropic就一直严格保密参数规模,不管是Opus还是Sonnet,愣是一点没披露。

越不说,网友讨论得越起劲。

我们用AI总结了一下网友们分析讨论的不同版本的Claude参数规模。

你还别说,你还真别说。最新模型Claude 4.6 Sonnet ~1-2T、Claude 4.6 Opus ~1.5-2.5T/2-5T,还真和老马手滑泄露的“Sonnet1T、Opus5T”对上了。

具体来看网友都讨论出来了啥。

目前主流推测方法有四类:

推理成本与吞吐量反推法:模型推理成本与激活参数量呈近似线性关系,而总参数量则可通过架构类型和行业经验系数推算。

性能基准对标法:通过与已知参数的开源模型在标准化基准上的表现对比,推断闭源模型的参数规模。

内部文件泄露与传闻分析法:官方意外暴露的信息&一些小道消息。

架构特性分析法:通过对模型行为特性的观察,推断其采用的架构类型,进而缩小参数估计范围。

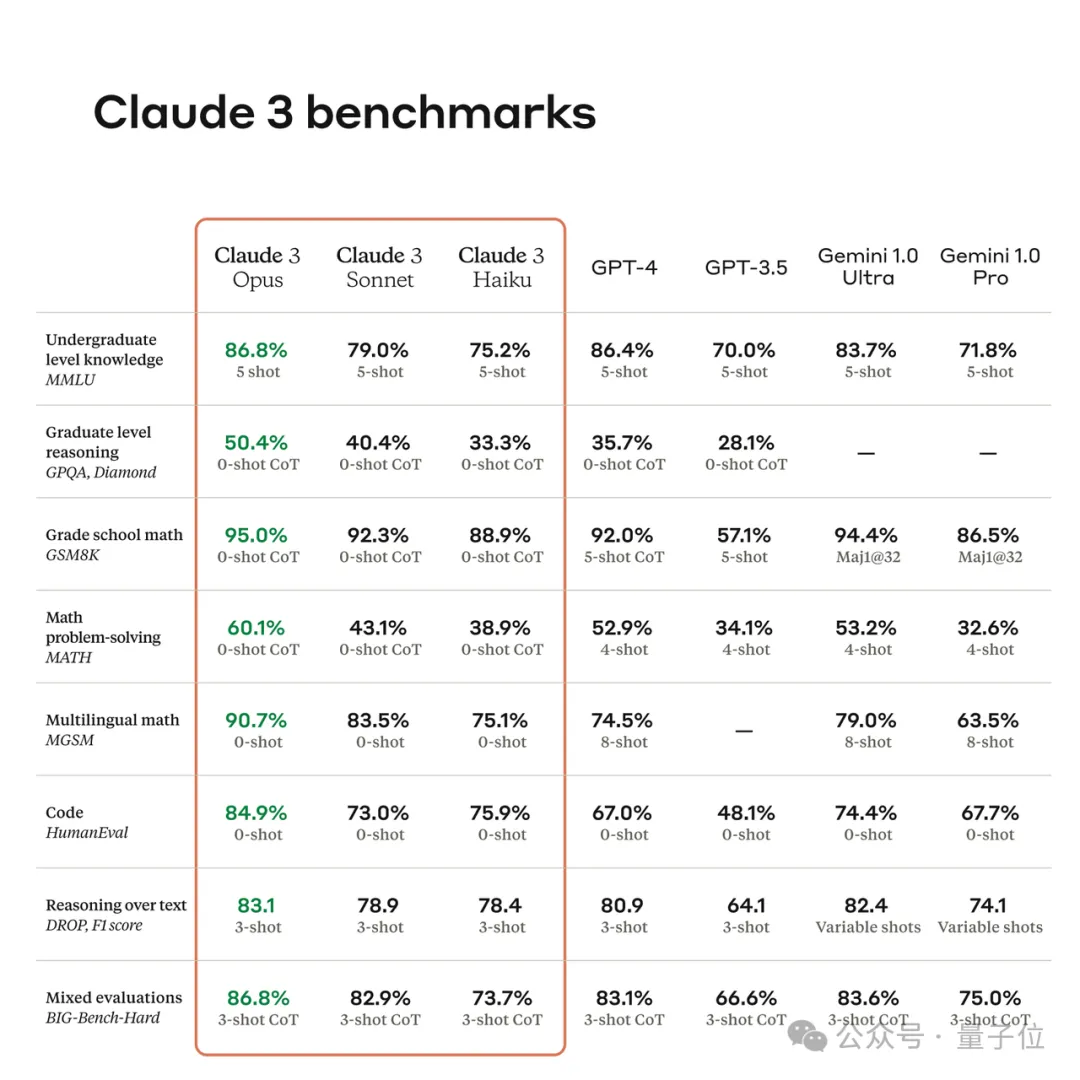

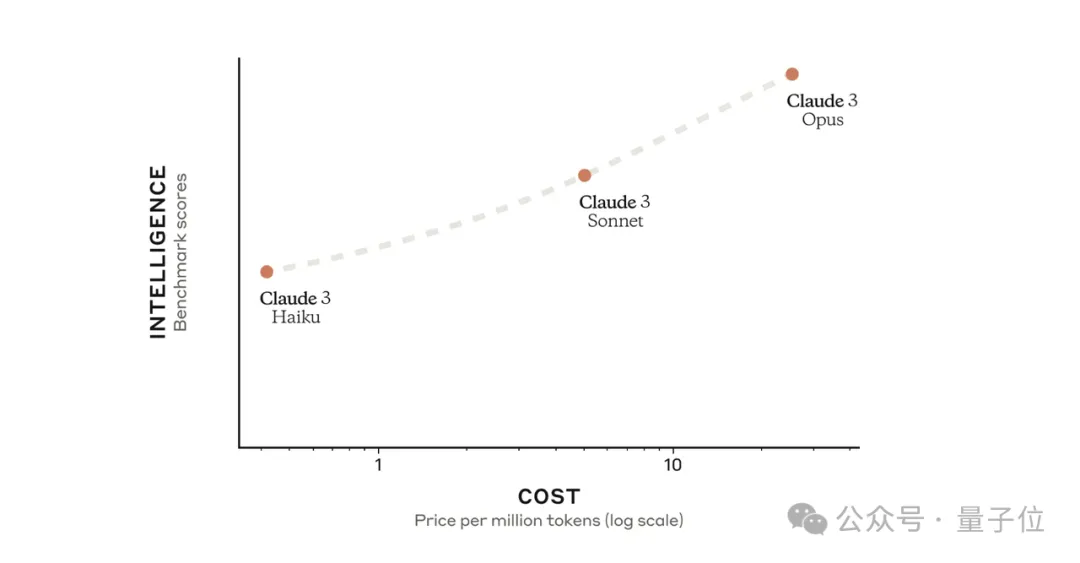

首先来看Claude 3系列,2024年3月发布,这是首个形成清晰产品矩阵的Claude系列,包含三个定位不同的版本。

小杯Haiku、中杯Sonnet以及大杯Opus,成本和性能依次递增。

对于它们的参数规模,LifeArchitect.ai创始人Alan D. Thompson曾给出估算: