谷歌DeepMind首发AGI终极考纲新智元

AGI,究竟如何评判?刚刚,谷歌DeepMind发出重磅论文,直接从认知科学「借」了一套度量衡——把通用智能拆成10大认知能力,配一套三阶段评估协议,还联合Kaggle砸了20万美金,向全球研究者悬赏:谁能测出真正的AGI?

如今的AGI,究竟到达哪一站了?

就在刚刚,谷歌DeepMind给出了AGI的终极度量衡!

这篇名为《Measuring Progress Toward AGI: A Cognitive Framework》的论文,核心主张只有一句话:别再争AGI是什么了,先把怎么测这件事搞清楚。

论文地址:https://storage.googleapis.com/deepmind-media/DeepMind.com/Blog/measuring-progress-toward-agi/measuring-progress-toward-agi-a-cognitive-framework.pdf

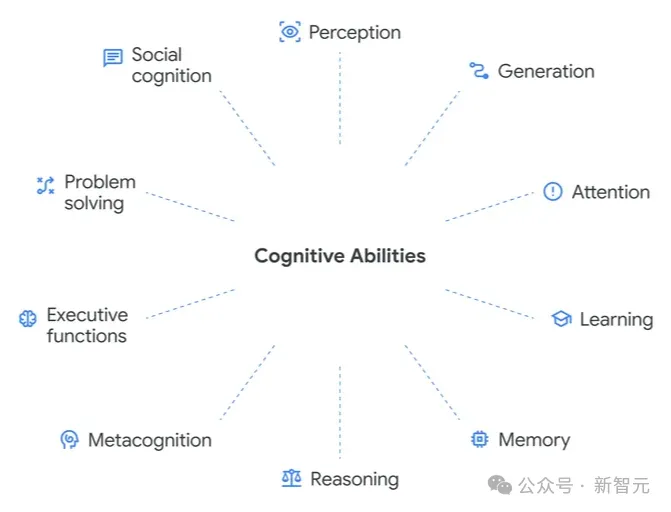

具体来说,AGI的评估被细化为10个关键的认知领域,包括感知、生成、注意力、学习、记忆、推理、元认知、执行功能、问题解决以及社会认知。

同时,谷歌DeepMind还想全球开发者,发起一场20万美元的Kaggle黑客松。

黑客松则是把出题权直接交给全球研究者——框架我搭好了,你们来帮忙造考卷。

从「AGI分级」到「AGI体检」

这不是DeepMind第一次尝试给AGI画路线图。

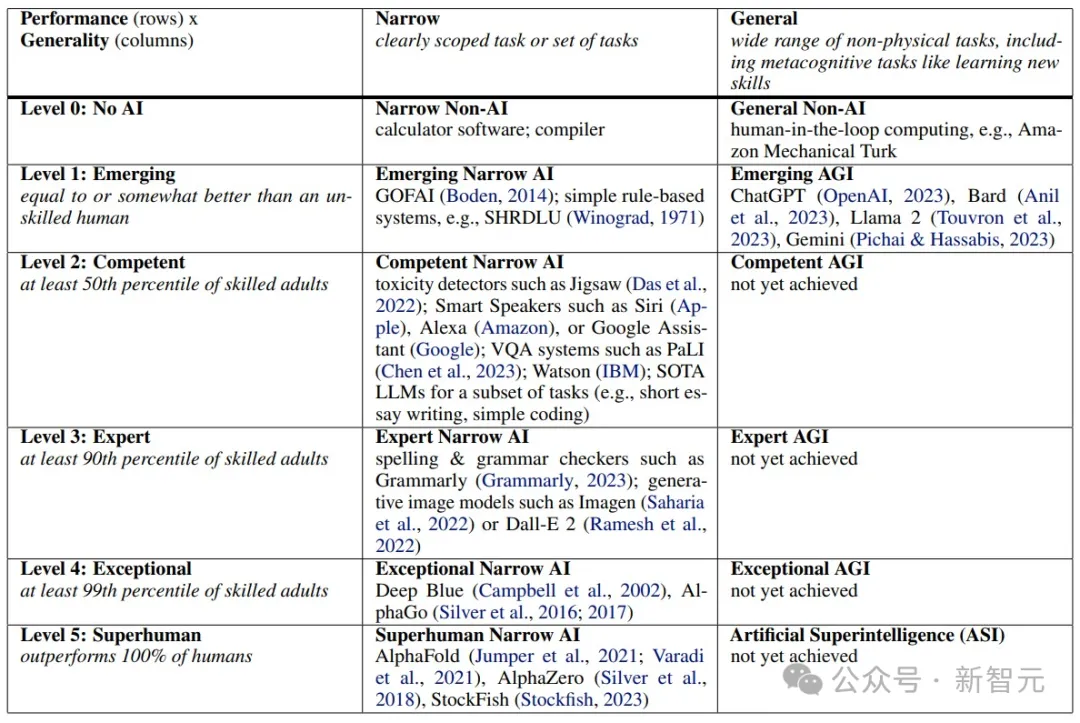

2023年,同一个团队发表了著名的「Levels of AGI」框架,把通往AGI的路拆成了5个性能等级。

从「新手」(Emerging)到「超人」(Superhuman),同时定义了6个自主性等级,从「纯工具」到「完全自主」。

那篇论文的影响力很大,它给了整个行业一套共同语言,就像自动驾驶领域的L1到L5一样,让大家至少能在同一个坐标系里对话。

但它留下了一个巨大的空白:台阶画好了,怎么测每一级?

新论文就是来补这个缺口的。

10大认知能力:给通用智能画一张地图

它的核心,是一套把通用智能拆解为10种关键认知能力的「认知分类法」(Cognitive Taxonomy)。

具体来说,要想评估AI和人类认知能力之间到底差多少,第一步就是要搞清楚:人类的认知都包括哪些关键过程。

过去很多年里,心理学、神经科学和认知科学通过做实验、脑成像、研究病例、以及建立模型等方式,已经积累了大量相关成果。

正是基于这些研究,团队整理出了一套认知分类体系,用来描述实现AGI所需要的核心能力。

先看8种基础能力。

1. 感知(Perception)

从环境中提取和处理感官信息。包括视觉感知(从低级的边缘检测到高级的场景理解)、听觉感知(从音高辨别到语音理解)、以及AI独有的文本感知。

LLM通过token化直接处理文本,本质上是一种人类不具备的独特感知模态。这种「超能力」绕过了视觉,径直抵达语言。

2. 生成(Generation)

产生文本、语音、动作(机器人控制、计算机操作)等输出。

其中最耐人寻味的是「思维生成」,也就是产生内部思考来指导决策。

DeepMind把这一项和OpenAI的o1式推理能力挂钩,并指出由于思维本质上是「内部的」,评估起来可能极其困难。

3. 注意力(Attention)

在信息过载时,就需要把认知资源集中到关键事物上。

这里有个微妙的平衡:既要专注于当前目标不被干扰,又要对环境中的意外变化保持警觉。太专注会错过危险信号,太分散又做不成事。

4. 学习(Learning)

通过经验获取新知识和技能。

包括概念形成、联想学习、强化学习、观察学习、程序性学习、语言学习六大类。

关键在于,真正的AGI应该能在部署后持续学习并保留新知识,而不仅仅是在训练阶段或上下文窗口内「临时抱佛脚」。

5. 记忆(Memory)

存储和检索信息的能力。

包括语义记忆(世界知识)、情景记忆(特定事件)、程序性记忆(技能)、前瞻性记忆(记住未来某个时刻该做的事),以及一个容易被忽视的能力——遗忘。