黄仁勋GTC演讲:推理时代到来华尔街日报

在GTC 2026大会上,英伟达CEO黄仁勋将公司定位为“AI工厂”构建者,称“到2027年将看到至少1万亿美元的高确信度需求”。他提出“Token工厂经济学”,强调每瓦性能是商业变现的核心。黄仁勋断言Agent(智能体)将终结传统SaaS模式,未来“年薪+Token预算”将成为职场新标配。

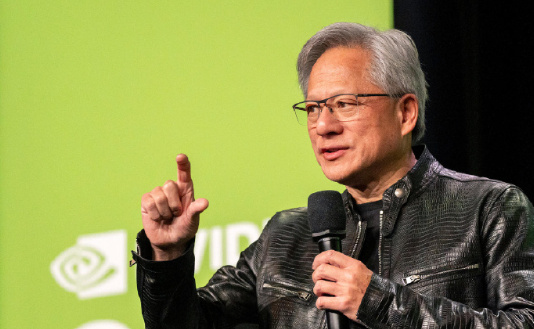

主持人: 欢迎英伟达创始人兼首席执行官黄仁勋登台。

黄仁勋,创始人兼首席执行官:

欢迎来到GTC。这是一场技术大会,看到这么多人一大早就排队入场,非常高兴。

今天我们将围绕三大平台展开讨论:CUDA-X平台、系统平台,以及全新的AI工厂平台。当然,最重要的是生态系统。

首先,我要感谢我们的"赛前热身"主持人,他们表现出色:来自Conviction的Sarah Guo、红杉资本的Alfred Lin(英伟达的第一位风险投资人),以及英伟达第一位重要机构投资人Gavin Baker。这三位对技术有着深刻的理解,在技术生态系统中拥有广泛的影响力。此外,也感谢我亲自挑选的所有贵宾。

同时,我要感谢所有参会企业。英伟达作为平台公司,拥有技术、平台和丰富的生态系统。今天,涵盖百万亿美元产业的企业几乎全部汇聚于此——450家企业赞助了本次活动,非常感谢。

本次大会共设1,000场技术专题,汇聚2,000位演讲嘉宾,将覆盖人工智能"五层蛋糕"的每一层——从土地、电力与基础设施,到芯片、平台、模型,以及最终推动整个产业腾飞的各类应用。

CUDA的20年历程

今年是CUDA诞生20周年。

20年来,我们始终致力于这一架构——这项革命性的发明:SIMT(单指令多线程),允许标量代码衍生为多线程应用,比传统方式更易于编程。近年来,我们还新增了Tiles(瓦片)支持,帮助开发者更便捷地对Tensor Core及当今AI数学结构进行编程。

迄今为止,CUDA已积累了数千种工具、编译器、框架与库,在开源社区中拥有数十万个公开项目,并已深度集成至每一个主流生态系统中。

飞轮效应与安装基础

最难实现、也最具战略价值的,是底层的安装基础。历经20年,我们在全球构建了数亿颗运行CUDA的GPU和计算系统。我们覆盖了每一家云服务商和每一家计算机厂商,服务于几乎每一个行业。

CUDA的安装基础,正是飞轮加速的根本原因。 庞大的安装基础吸引开发者,开发者创造新算法,新算法催生突破——例如深度学习的诞生。这些突破开辟全新市场,新市场汇聚更多生态伙伴,进而形成更大的安装基础。这一飞轮正在持续加速。

目前,英伟达库的下载量正以惊人速度增长,且增速仍在不断提升。这一飞轮使得计算平台能够持续支撑海量应用和层出不穷的技术突破。

更重要的是,它也使基础设施拥有了极长的使用寿命。原因很简单:英伟达 CUDA能运行的应用范围极广,覆盖AI生命周期的每个阶段、每种数据处理平台,以及各类科学原理求解器,因此一旦安装英伟达 GPU,其使用寿命便极为可观。

这也解释了为什么我们六年前发布的Ampere架构,其云端定价至今仍在上涨。

与此同时,随着我们持续更新软件,计算成本也在不断下降——这不仅体现在初次部署时的性能跃升,更体现在加速计算带来的长期持续降本效应。由于所有GPU在架构上互相兼容,我们愿意持续支持和维护全球每一块GPU。安装基础越大,每次新优化所惠及的用户就越多。

这一动态组合,使英伟达架构在扩大覆盖范围、加速增长的同时,持续压低计算成本,从而反过来推动新一轮增长。

CUDA的起点:GeForce

CUDA的旅程,实际上始于25年前的GeForce。

GeForce是英伟达有史以来最成功的市场营销。我们从你们还年幼、尚未具备消费能力时就开始吸引未来的客户——那时是你们的父母在为你们买单,年复一年,直到有一天你们成长为出色的计算机科学家,成为真正的开发者。

25年前,我们发明了可编程着色器——世界上第一款可编程加速器,也是像素着色器的起点。这一发明驱动我们不断深入探索,5年后催生了CUDA。

将CUDA从GeForce推广到每一台计算机,是我们当时最重大的投资之一——即便当时难以负担,它也消耗了公司绝大部分利润。我们坚信其潜力,尽管初期艰辛,但经过20年、13代架构的坚守,CUDA如今已无处不在。

大约8年前,我们推出了RTX,对架构进行了彻底重新设计,引入了两项当时全新的理念:硬件光线追踪与AI驱动的图形渲染。就如同GeForce将AI带到了世界面前——让Alex Krizhevsky、Ilya Sutskever、Geoffrey Hinton、Andrew Ng等人发现GPU是加速深度学习的利器,从而点燃了AI的大爆炸——如今,AI也将反过来彻底革新计算机图形学。

神经渲染:DLSS 5

今天,我要向大家展示图形技术的未来。我们称之为神经渲染——3D图形与人工智能的融合,这就是DLSS 5。

效果震撼,对吧?我们将可控的3D图形(虚拟世界的"结构化数据")与生成式AI(概率计算)融合在一起:一个完全可预测,另一个概率驱动却高度逼真。两者结合,生成的内容既美观、逼真,又完全可控。

结构化信息与生成式AI的融合,将在一个又一个行业中不断重演。结构化数据,是可信AI的基石。

结构化数据与非结构化数据平台

接下来这张图可能会让你们有些震惊,但请耐心听我说完。

结构化数据——SQL、Spark、Pandas、Velox,以及Snowflake、Databricks、Amazon EMR、Azure Fabric、Google BigQuery等重要平台——都在处理数据框(Data Frame)。这些数据框本质上是巨型电子表格,承载着所有业务信息,是企业计算的"基准事实"。

在AI时代,这些结构化数据将被AI高速调用,因此必须被极致加速。未来的AI Agent也将广泛使用结构化数据库。

非结构化数据则代表着世界上绝大多数的信息:向量数据库、PDF、视频、语音……全球每年生成的信息中,约90%都是非结构化数据。过去,这些数据几乎毫无用处——我们将它们存入文件系统,却无法检索、无法查询。

现在,AI改变了这一切。就像AI解决了多模态感知与理解问题,同样的技术可以读取PDF、理解其含义,并将其嵌入可检索、可查询的更大结构中。

为此,英伟达创建了两个基础库:

cuDF:用于数据框(Data Frame)和结构化数据加速

cuVS:用于向量存储(Vector Store)、语义数据和非结构化AI数据加速

这两个平台将成为未来最重要的计算平台之一。

今天,我们正式宣布多项合作:

IBM(SQL的发明者)正在使用cuDF加速其WatsonX数据平台

戴尔与我们合作打造了Dell AI数据平台,整合cuDF与cuVS,专为AI时代设计

Google Cloud:我们加速其Vertex AI和BigQuery平台;以Snapchat为例,我们帮助其将计算成本降低了近80%

AWS:我们加速EMR、SageMaker和Bedrock,并将把OpenAI引入AWS,推动其大规模云计算消费

Microsoft Azure:我们加速Azure AI Foundry,深度支持必应搜索,并扩展Azure区域部署

CoreWeave:全球第一家AI原生云,为GPU托管和AI推理而生

Oracle:我们是Oracle的第一位AI客户

Palantir + 戴尔:三方合作,可在任意国家、任意隔离区域、完全本地化地部署AI平台

英伟达的核心战略:垂直整合,水平开放

英伟达是全球首家垂直整合、同时水平开放的计算公司。

加速计算不是一个芯片问题,也不是一个系统问题,其核心是应用加速。要持续为每个应用领域带来显著加速和成本降低,就必须深入理解应用、理解领域、理解算法,并在每一种部署场景中落地实施——无论是数据中心云端、本地部署、边缘计算还是机器人系统。