辛顿90分钟科普播客:这次,为何不同?高飞的电子设备

又是一篇超万字的博客😓,眼花缭乱中。

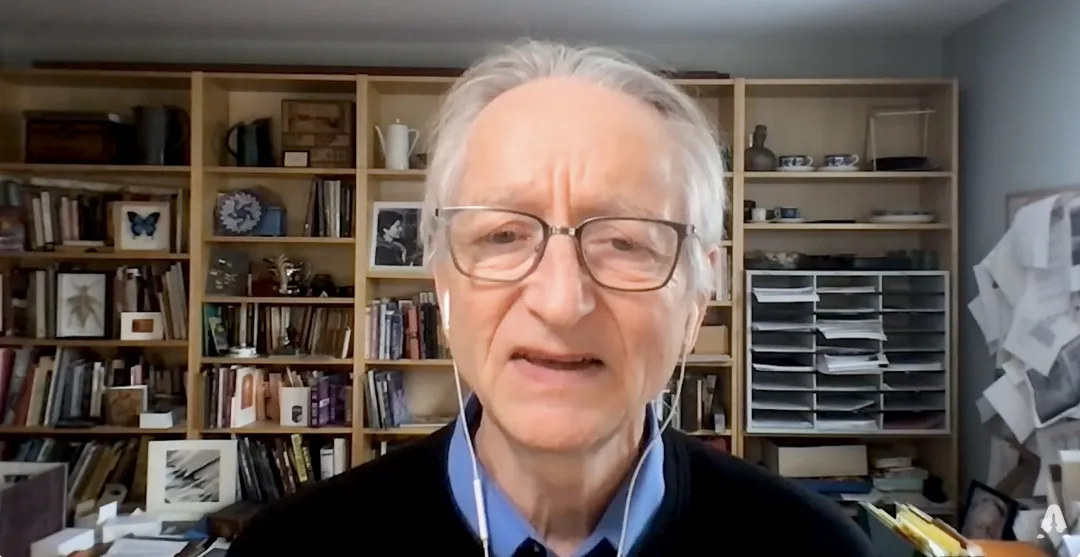

杰弗里·辛顿(Geoffrey Hinton)刚刚上线了一期90分钟的播客,发布十天播放量已超过百万次。

辛顿在过去两年里接受过大量采访,从CNN到BBC到60 Minutes,但几乎所有对话都集中在同一个主题:AI的风险有多大、失业潮何时到来、我们该多紧张。这些采访有价值,但如果你已经跟踪过辛顿的公开发言,会发现核心判断在不同场合反复出现。这次不一样。这期节目里他做了一件在其他采访中从未做过的事:从零开始,一层一层地拆解神经网络到底怎么工作。 他用识别一只鸟的例子讲清了从像素到语义的层级跃迁,用一根弹力绳讲透了反向传播的数学直觉,用堆肥堆和原子弹的类比证明AI已经理解了链式反应的深层结构,用一个棱镜实验论证多模态聊天机器人已经具有主观体验。这些内容在他之前的公开访谈中极为罕见——他通常把这些留给自己的大学课堂。

让他打开这个模式的,是这档节目的独特结构。

StarTalk是美国科学播客领域的头部品牌,YouTube频道订阅量超过543万,已播出超过1000期。主持人尼尔·德格拉斯·泰森(Neil deGrasse Tyson)是纽约海登天文馆馆长,大概是过去二十年里美国公众辨识度最高的科学传播者。节目的常驻搭档查克·奈斯(Chuck Nice)是职业喜剧演员,加里·奥莱利(Gary O'Reilly)是前职业足球运动员。

这个配置的效果是:当嘉宾说出一个在学术会议上只会引发同行点头的判断时,奈斯和奥莱利会代替普通听众做出最诚实的反应——停下来,要求把刚才那句话再说一遍。对于复杂话题来说,这种"等一下你刚才说什么"的打断往往比追问本身更有价值,因为它逼迫嘉宾用更直观的方式重新表述。辛顿显然享受这个过程。他在节目里用了大量面向物理学背景听众设计的类比(泰森的观众群以理工科为主),而奈斯的即时追问则确保没有听众被落下。

虽然辛顿现在大概是AI领域公众认知度最高的名字了,但他的核心贡献值得继续重复再重复了。他从1980年代开始系统地研究如何用反向传播算法训练多层神经网络,在当时学术界普遍认为这条路走不通的年代坚持了下来。他的工作直接催生了今天大语言模型和计算机视觉系统的技术基础。他是多伦多大学计算机科学系荣休教授,2013年被Google收购了他与学生联合创办的DNNresearch,此后在Google工作十年。2018年,他与约书亚·本吉奥(Yoshua Bengio)、杨立昆(Yann LeCun)三人因在深度学习领域的奠基性贡献共同获得图灵奖。2024年,他又与物理学家约翰·霍普菲尔德(John Hopfield)共同获得诺贝尔物理学奖,成为继1978年的赫伯特·西蒙(Herbert Simon)之后第二位同时拥有这两项荣誉的人。2023年他从Google离职后成为AI风险领域最具公信力的预警者。

以下是这次对话的完整梳理。

1. 1950年代的分裂:逻辑派和大脑派

AI研究从诞生之初就分裂成两个阵营,这条裂缝至今没有完全愈合。

一派相信智能的本质是逻辑推理。写好前提,定好规则,用规则操纵符号推导出新结论,就像数学家处理方程。这是"符号AI"的路线,后来发展成专家系统,在学术界和工业界主导了几十年。

另一派从生物出发。他们的论点是:我们所知的聪明东西都有大脑,而大脑擅长的是感知和类比推理,真正的逻辑推理反而要到十几岁才发育成熟。所以应该先研究大规模神经元网络如何完成感知和记忆。

辛顿属于第二派。他提到,这个阵营早期的支持者里包括冯·诺依曼(现代计算机架构的设计者)和图灵(可计算理论的奠基人,也就是图灵奖命名所纪念的那个人),可惜两人都英年早逝。"图灵可能还有英国情报机构的帮忙",辛顿说。这是指图灵因同性恋身份遭英国政府迫害、最终疑似被逼自杀的历史。

辛顿自己的兴趣起源于1960年代中期的高中时代。一个数学很好的朋友告诉他一个当时很新的想法:记忆可能不是存储在单个脑细胞里,而是分布在大量脑细胞的连接模式上。这个概念受到全息术的启发。匈牙利物理学家丹尼斯·盖伯(Dennis Gabor)发明的全息图刚刚问世,它的一个特性是信息分布在整个介质上,打碎一部分仍能还原完整图像。"从那以后,我一直在想大脑是怎么存储记忆的,实际上是怎么工作的。"

1970年代辛顿成为研究生时,意识到一种新的验证方法:不管你对大脑有什么理论,都可以在数字计算机上模拟它来检验,除非你认为大脑的核心机制依赖量子效应。"我们先别去敲彭罗斯的门",他开玩笑说。这里的彭罗斯是数学物理学家罗杰·彭罗斯(Roger Penrose),他和麻醉学家斯图尔特·哈默罗夫(Stuart Hameroff)曾提出一种有争议的理论,认为意识源于神经元内部的量子过程。辛顿显然不买这个账。

问题是,当你真的在计算机上跑大多数当时流行的大脑理论时,发现它们不工作。辛顿花了职业生涯的大部分时间解决一个具体问题:如何调整神经元之间的连接强度来学习复杂的东西,并且在数字计算机上确实能跑通。

结果是一个让他自己也不安的发现。他说自己未能理解大脑的工作方式,但弄明白了如何在数字计算机上做到同样的事。 2023年初,这个认知让他开始紧张:如果数字计算机上的学习方法比大脑的方法更高效,那数字智能(digital intelligence)可能就是比人类大脑这种模拟系统(analog intelligence)更强。

2. 从一堆数字到"这是一只鸟"

理解神经网络需要先理解一个问题:为什么识别图片里有没有鸟这件事,对计算机来说这么难。

辛顿在节目里说他有一门18小时的课讲这个,但会试着压缩。他选了一个面向物理学背景听众的入口:气体定律。你压缩气体,气体变热,为什么?因为宏观行为(温度上升)是由微观的大量原子高速运动来解释的。两个层次的现象类型完全不同。神经网络的思路类似:我们做推理时那种有意识的符号操作,底下有更复杂的微观神经活动在支撑。搞清楚了微观层,才能真正解释宏观层。

他用的核心例子是图像识别。一张灰度图片在计算机看来就是一大堆数字,每个数字代表一个像素的亮度。任务是判断图里有没有鸟。

这件事之所以困难,是因为单个像素什么都说明不了。鸟可以是黑的也可以是白的,可以占满整张图也可以只是远处天上的一个点,可能被树丛遮住大半。人们用传统编程方法尝试了半个世纪,都没有真正解决它。

辛顿的讲解策略是:先假设由他手工搭建一个神经网络,让听众理解每一层在做什么,然后再解释为什么手工搭建行不通、必须让机器自己学。

第一层的任务是找边缘。 他用了一个天平的比喻。取相邻两列像素,左列亮度放天平一端,右列放另一端。如果左亮右暗,天平倾斜,神经元兴奋,它检测到一条"左亮右暗的边缘"。如果两边一样亮,天平平衡,输出为零。人类大脑视觉皮层的早期阶段做的也是这件事:在不同位置、不同朝向、不同尺度上部署成千上万个边缘检测器。辛顿举了两个极端来说明"尺度"的含义:云的软边缘需要大尺度的模糊检测器,远处一只老鼠尾巴消失在墙角需要精细的小尺度检测器。

第二层把边缘组合成可能的部件。 几条向右下方和右上方倾斜的小边缘汇合在一个点形成尖角,这可能是箭头也可能是鸟喙。几条弯边围成近似的圆,可能是按钮也可能是鸟眼。关键词是"可能",第二层不做最终判断,只是向上传递证据。

第三层开始处理空间关系。 一个可能的鸟眼和一个可能的鸟喙处在正确的相对位置上,第三层判定"这可能是鸟头"。最后的输出层汇总鸟头、鸟脚、翅膀尖端的信号,给出"是鸟"的判断。

每一层都在上一层基础上提取更抽象的特征。这就是"深度学习"里"深度"的含义,就是多层。

奈斯在这里提了一个关键问题:那是不是要把所有可能的鸟都训练一遍?辛顿的回答指向了神经网络区别于查表式程序的核心能力:泛化。网络在学习大量数据时并不逐条记忆,它提取的是可迁移的规律。一个训练过大量动物图片的网络可以识别独角兽,哪怕它从来没见过独角兽,因为它已经学会了"四条腿""马的体型""头上有突出物"这些可拆解、可组合的特征。

这也解释了为什么你在云里画一个弯曲的V形,所有人都说"那是鸟"。大脑没有在查表,它学到了"翅膀展开的轮廓"这个高度抽象的特征,能在完全不同的场景中被激活。

但手工搭建这样一个网络在实践中不可能。你需要覆盖所有位置、朝向、尺度的组合,还要设计对猫、狗乃至政客(辛顿的原词)都有效的通用特征。一个合格的网络至少需要十亿个连接权重。"你大概需要一千万个研究生来手工调这些参数。想想你要写多少经费申请来雇他们。"

问题由此转向:这十亿个连接权重,能不能让机器自己学出来?

3. 弹力绳和反向传播:一次计算替代十亿次实验

辛顿说了一个"听起来很蠢但确实管用"的起点:从随机数开始。

所有连接权重一开始都是随机的正数或负数。输入一张鸟的图片,猫、狗、鸟、政客四个输出神经元都会被微弱激活,程度差不多。没有用处。

最直观的改进方法是逐个试错:把某个连接权重增大一点,看"鸟"的输出有没有变强。如果变强了就保留这次调整。但十亿个连接每个要试很多次,这种方法的时间成本等于无穷大。

辛顿在这里给了一个面向物理学听众设计的类比。网络输入一张鸟的图片后,"鸟"那个输出神经元只有微弱反应,离正确答案差很远。想象你在它的当前值和正确答案之间拉一根弹力绳,绳子越长拉力越大,方向指向"你该更确信这是鸟"。但这个神经元的输出是被它前面所有层的权重共同决定的,它自己动不了。