辛顿的AI课:装傻骗人,自我修正,无限复制51CTO技术栈

前几天,AI奠基人、图灵奖得主、诺贝尔奖得主 Geoffrey Hinton(辛顿,文中以下都用这个称呼),来了一场开年“大师级”的AI课堂。

明明是一场 StarTalk 播客,三位主持人却似乎成为了沉浸其中的三名学生。

如果你有听过辛顿大神的演讲,就会发现,他的分享总有一种独特的气质:明明是在讲解很严肃的问题,但话锋之中总带有一丝幽默感。(按下不表,大家文中细品。)

播客中,辛顿教授回答了诸多关于生成式AI现状和未来的关键问题。

比如,他解释了,如此强大到甚至某些超越人的 AI 能力其实来自于神经网络的连接数量。

而对于“规模定律是否见顶”,辛顿认为:并不会,已经有网络可以为自己生成训练数据。而语言模型的下一步路径,辛顿表示和 ilya 讨论过这个问题,答案就是系统自我检查、修正自身信念,这样就能持续进化。

此外,辛顿还特别提到了AI的另一面:擅长“装傻”以欺骗人类。辛顿称之为 “Volkswagen Effect”,模型可能会故意表现不佳,以避免被拔掉电源。

所以,他认为:“如果松开权重,AI 会具备变成极端、纳粹的能力。”

此外,AI发展的速度之快,以至于留给外界太多神秘“玄学”的说法。辛顿也都一一给出了回应。

比如“AI是否拥有意识”的问题,辛顿首先把“意识”这个概念去神秘化了,它本身就不是一个科学问题。

意识”更像“燃素”(phlogiston):一种为了说明现象而虚构的“本质”。当我们真正理解那些现象后,就不再需要这种假设。

所以,AI本身就不需要意识。但AI已经具备了类似人的“主观体验”。

再比如,辛顿也把奇点的临近被“去戏剧化”。他表示,AI不会一次性全面碾压人类,更多还是分阶段、逐个领域实现超越。

而且,辛顿表示,AI的未来既不必然灾难,也不必然乐观。因为 AI 不同于核武器,它的确可以在气候变化、药物发现、新能源发现等更大的社会问题上发挥重要作用。

那对于未来会什么什么样子呢?

辛顿表示,十年后的 AI 根本无法预测。

“如果技术进步是指数型的,我们却用线性思维去预测未来,就会犯大错。你也许能预测几年内的变化,但十年后的世界几乎无法想象。”

Sam 曾乐观的设想了一种“全面基本收入”的世界,但辛顿对此表达了顾虑:UBI 解决得了温饱,却解决不了人类尊严的问题。此外,AI大量取代人类脑力劳动,也会带来新的问题。

“如果用 AI 替代工人,政府失去税收来源,就必须向 AI 征税,而大公司未必愿意。”

同时,辛顿又给“AI会带来新就业机会泼了一盆冷水”:关键在于连“脑力劳动”都被 AI 取代了之后,人类还能去哪里呢?无论产生什么新工作,AI都要比人类便宜。

另外,关于五角大楼最近跟Anthropic就 AI 武器的“理念冲突”,此次播客中也有谈及,辛顿表示,在实战中,每次决策都必须经过人类确认的做法同样存在问题。

美国军方现在说的更多是“人类监督”,并没有承诺“每次决策都有人类参与”。

在实战中,比如无人机对抗坦克,根本没有时间等待人工确认,士兵的生命怎么保证呢?

总之,如果你对 AI 的现状和未来感兴趣,这篇“顶级大神”的播客,绝对会让你茅塞顿开。

AI在学习方面比人类更强吗?

辛顿认为,AI解决的是和人类略有不同的问题。

人脑大约有一百万亿个连接,看起来很多,但人的一生大概只有二十亿秒。

如果把你拥有的连接数量和经历过的时间相比,你的连接远远多于经验。

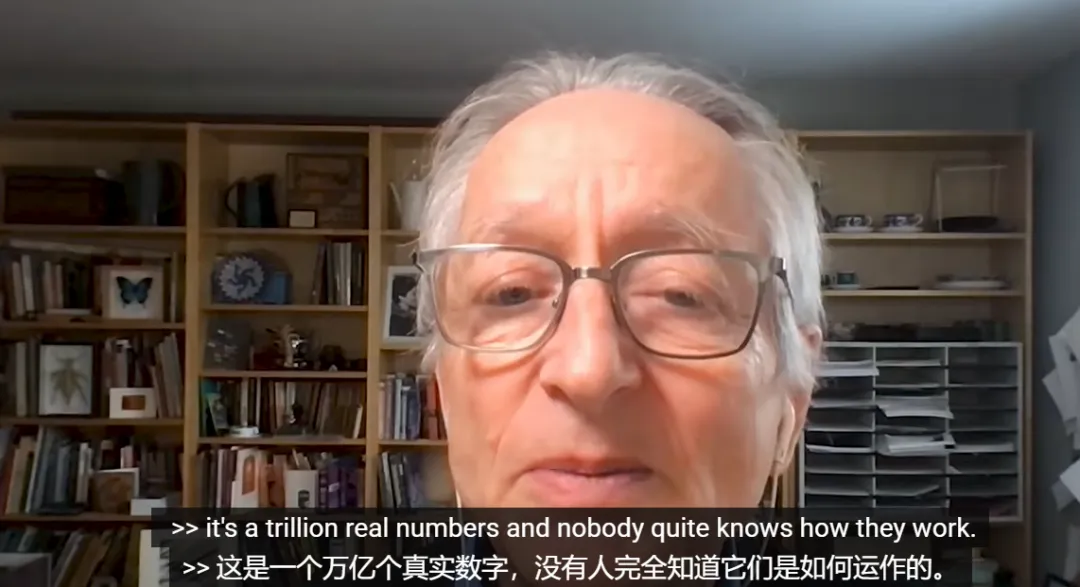

而神经网络正好相反。即便是大型语言模型,也只有大约一万亿个连接——大约是大脑连接数的1%。而它们中的很多模型,连接数更少,但获得的经验却是你的成千上万倍。对吧?

大型语言模型面对的问题是:只有大约一万亿个连接,如何利用海量经验。反向传播非常擅长把巨量知识压缩进相对有限的连接里。

但那不是我们(人脑)在解决的问题。

我们拥有极其庞大的连接数量,却经验有限。我们需要从每一次经验中尽可能多地提取信息。所以我们解决的是略有不同的问题。这也是为什么人脑未必在使用反向传播。

不过,如果我们用“蛮力”——不断增加神经网络的连接规模——它的思考能力会不会直接超过我们?它有 100 万亿个连接呢?规模就会带来更多更多的经验。

“规模效应”是否见顶?

关于规模效应。辛顿分享了三点看法。

首先,规模效应是可以提前预测的。

过去好几年里,每次把网络做大、给更多数据,它都会变得更好,而且提升是可预测的。你甚至可以提前算:多花 1 亿美元把模型做大这么多、加这么多数据,它会提高多少,值不值。

其次,现在的问题变成了:这种“规模定律”是否正在见顶。他认为,有些网络可能会见顶,但也有些不会——只要你继续扩大规模、增加数据,它们就会不断变强。

他表示,现在有些网络已经可以生成自己的数据,这有点像钚反应堆能自己生成燃料。

比如 AlphaGo。早期围棋程序是模仿人类专家的棋谱训练的。那样的话,你永远不可能远远超过专家,而且专家数据也有限。

后来它开始“自我对弈”。当它与自己对弈时,就可以无限生成数据,不断提升。它每秒可以对弈成千上万盘,甚至占用谷歌大量计算资源。

最后,事实证明,AlphaGo 远远强于任何人类棋手。这确实令人不安。

语言模型也会像AlphaGo那样超越人类吗?

LLM下一步:自我修正

问题来了:既然它在棋类上能超越我们,语言会不会也如此?

辛顿表示,目前语言模型的训练方式,类似早期围棋程序模仿专家——通过预测文本中的下一个词。这就像预测专家的下一步棋。那样很难远超专家。

但是否有另一种路径?有。

像 AlphaGo 那样“自我对弈”。对于语言模型来说,如果它能对自身已有的信念进行推理:

“如果我相信 A 和 B,那么通过推理我应该也相信 C。但我并不相信 C。那说明我的信念体系内部存在矛盾。”

于是它可以修正前提、修正结论,或修正推理方式。

这种从“内部不一致”中学习的能力,不需要外部数据。只要它关心一致性,就能变得更聪明。

辛顿最后强调,如果系统在意一致性,它只需要检查自身信念,就能持续进化。关于这一点,辛顿几年前曾和 Ilya Sutskever 讨论过,他们都认为这是语言模型继续提升的路径。