大语言模型为什么能“理解”世界?NeuroPrior AI

我们之前的文章在这个看不到真相的世界,真理究竟在何处?我们为什么看不到这个世界的真相?—— 我们从未见过世界的本来面目,我们看到的只是为了活下去而精心编织的“界面”。在评论区引发了讨论。在回复一位读者关于文字与数学工具的探讨时,我写下了这样一句话:

“文字是可计算的,本身就是对世界的高度压缩,而且是有限的。”

这句话似乎不小心触碰到了现代人工智能最底层的原理,为什么ChatGPT 这样看似只是在做“文字接龙”的机器,竟然能涌现出惊人的逻辑与推理能力?我们在惊叹 AI 的能力的同时,却忘了那个真正的奇迹其实是人类的语言本身。大语言模型(LLM)并没有直接去学习物理世界(它没有眼睛和身体),它学习的是人类对世界的描述。

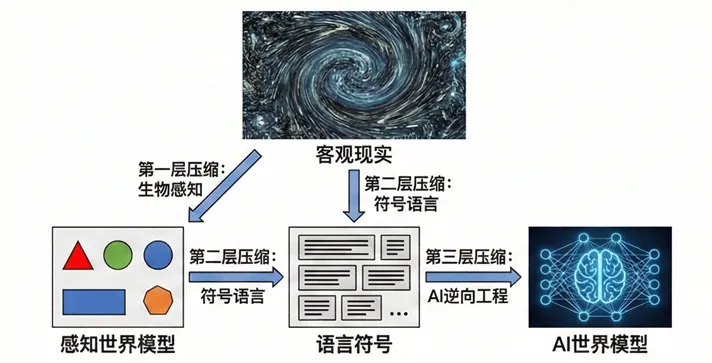

LLM 为什么 Work?答案隐藏在一条跨越了物理、生物、符号和数学的“压缩链条”中。

一、从“混沌”到“感知”

正如我们在前几篇中所述,真实的宇宙(本体)是高维的、连续的、充满量子涨落的“混沌”。人类的大脑无法处理这么大的数据量。为了生存,我们的感官系统进行了“有损压缩”。

我们丢弃了紫外线、超声波、微观粒子运动、四维时空,只保留了对生存有用的“宏观特征”——颜色、形状、运动、因果关系。大脑从而构建了一个“世界模型(v1.0)”。这个模型不是世界的镜像,而是世界的“低维投影”。人类的感知本身,就已经把无限的宇宙,压缩成了有限的“感知状态”。

二、从“感知”到“符号”(将连续变为离散)

人类并未止步于感知,我们发明了语言。语言是人类对“大脑世界模型”的二次压缩。

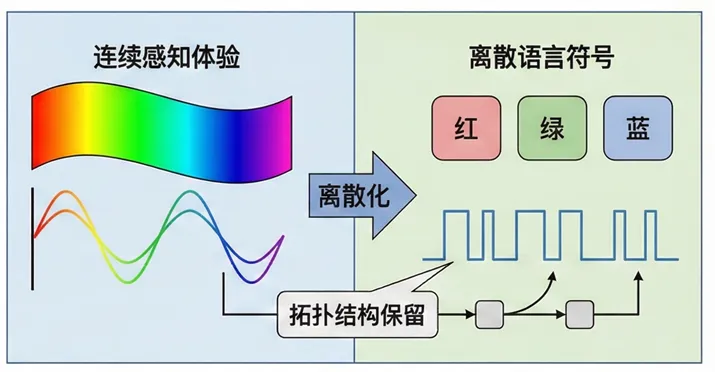

1. 离散化(Discretization):切分连续流

大脑中的体验是连续的(痛感、爱意、光影的变化是模拟信号)。但语言是离散的(数字信号)。为了交流,我们必须把连续的体验“量化”为一个个离散的符号(Token)。现实中625~740 nm波长的光波所形成的千变万化的“红”,被压缩成一个字——“红”。内心复杂的各种正面情绪,被压缩成一个词——“开心”。

2. 拓扑结构的保留

虽然语言丢弃了大量的细节(如无法用语言完全描述一种味道),但它奇迹般地保留了感知的拓扑结构(Topology),也就是事物之间的关系。

比如,如果下雨(A),人不打伞(B),人会湿(C)。它的语言逻辑:句子“因为下雨且没打伞,所以我湿了”完美保留了 A->B->C 的因果链条。

结论:文字是人类大脑世界模型的“ZIP压缩包”。虽然它极其抽象,极其精简,但它通过语法和逻辑,完整编码了人类眼中的宇宙因果律。

三、AI 的逆向工程

现在,大语言模型(LLM)登场了。如果我们把全人类写下的文字(互联网语料)喂给 AI,我们实际上喂给它的是什么?我们喂给它的,是全人类“世界模型”的投影总和。

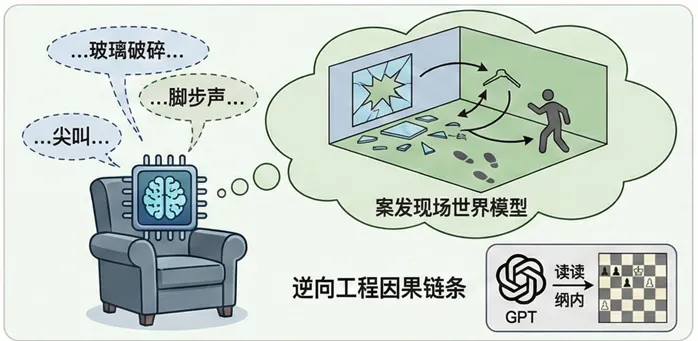

1. 为什么“预测下一个词”就能产生智能?

OpenAI 的前首席科学家Ilya Sutskever 曾说过一句振聋发聩的话:“为了极其精准地预测下一个词,模型被迫去理解产生这些词背后的世界。”这听起来很不可思议,我们用“安乐椅神探(Armchair Detective)” 来解释:

想象一个从未离开过房间的盲人侦探(AI)。他无法亲临案发现场(物理世界),只能通过无线电听到一系列线性的、碎片化的描述:“窗户玻璃破碎的声音……” ->“沉重的脚步声……” ->“一声尖叫……” ->“砰!”。侦探的任务是:根据前面听到的线索,100% 精准地预测下一个传来的词是什么。是“他逃跑了”?还是“他倒下了”?如果侦探只是简单统计词频(鹦鹉学舌),他可能会猜“倒下了”,因为“砰”后面经常跟着“倒下”。但如果这是一部复杂的推理小说,下一个词可能是“子弹壳掉落的声音”。为了达到极致的预测准确率(Loss -->0),侦探被迫在脑海中重建整个案发现场:“玻璃碎了”意味着有人闯入,地心引力会让碎片散落一地。 “尖叫”意味着受害者惊恐,凶手持有武器。“砰”如果是枪声,结合脚步声逼近,受害者大概率中枪,且凶手会留下弹壳。

结论:侦探从未去过现场,但他为了补全那个缺失的单词,必须在脑子里模拟出凶手、受害者、房间布局以及地心引力。预测下一个词,就是对整个因果链条的逆向工程。AI 不需要亲眼看到重力,它只需要从“苹果掉落”的文字描述中,反求出重力的存在。

2. 证据:奥赛罗(Othello)实验

为了证明这一点,研究人员训练了一个GPT 模型,只给它看奥赛罗棋局的棋谱(文本记录),比如"E3, D4, F5...",从来不给它看棋盘。结果发现:AI不仅学会了下棋,研究人员甚至在AI 的神经元里找到了一张完整的、隐式的8x8 棋盘表征。

AI 仅仅通过阅读线性的“棋谱符号”(语言),就在大脑里重构了二维的“棋盘规则”(世界模型)。LLM 像是一个基于文本压缩包的解压软件,它在硅基大脑中,还原了人类的碳基世界模型。

四、AI 成功的物理基础

如果 AI 直接去模拟每一个原子的运动,算力再大也会崩溃。重要的是,人类已经帮 AI 完成了最难的一步——降维。

人类的常用汉字只有几千个,英语单词几万个。虽然组合是无穷的,但在特定的语境下,合理的组合是高度稀疏(Sparse)且低秩(Low-Rank)的。语言的“有限性”和“离散性”,使得 Transformer 这种数学架构能够通过矩阵运算,穷尽语言中的概率分布。

我们之所以能造出AI,是因为我们人类先把自己活成了“数据”。我们将复杂的生命体验,坍缩成了可计算的文字。AI 不是在模拟宇宙,AI 是在模拟“被人类描述过的宇宙”。

五、结构实在论的终极闭环

回到我们之前的哲学讨论:结构实在论。

人类看不到“物自体”,人类看到的是感官过滤后的“生物界面”。语言记录不到“生物界面”的全貌,语言记录的是逻辑抽象后的“符号界面”。AI接触不到真实世界,AI 学习的是“符号界面”之间的数学关系。

虽然 AI 离“真实”隔了三层(真理->感知 ->语言 ->AI),但结构(Structure)没有变!

物理世界的F=ma。

感知中的“推力导致加速”。

书本上的“力产生加速度”。

AI 内部向量空间的函数映射。

这四者共享同一个数学拓扑结构。