AI教父Geoffrey Hinton:全球第二新智元

Hinton百万引用的背后,是数篇奠基「现代人工智能」的不朽之作!

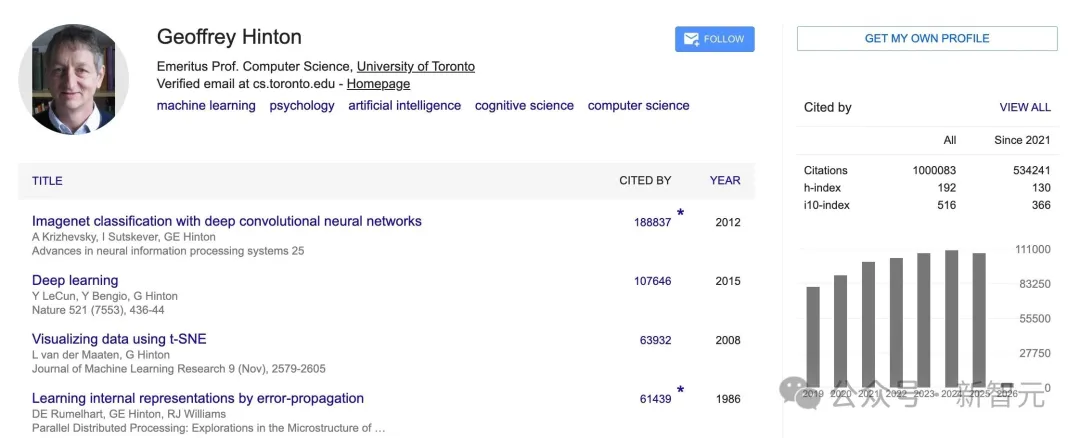

刚刚,AI教父、图灵奖巨头Geoffrey Hinton论文被引数正式破100万!

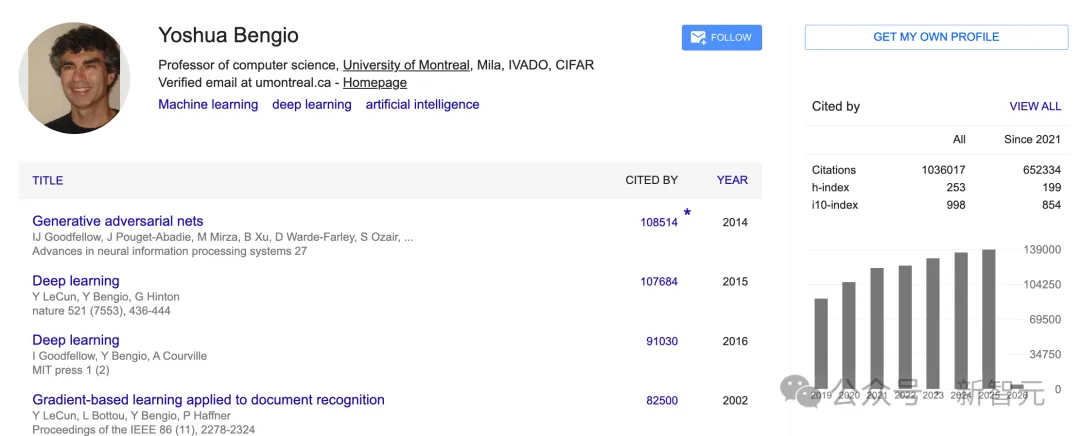

他是继Yoshua Bengio之后,全球第二位论文引用量突破百万的学者。

学术地位无可撼动!

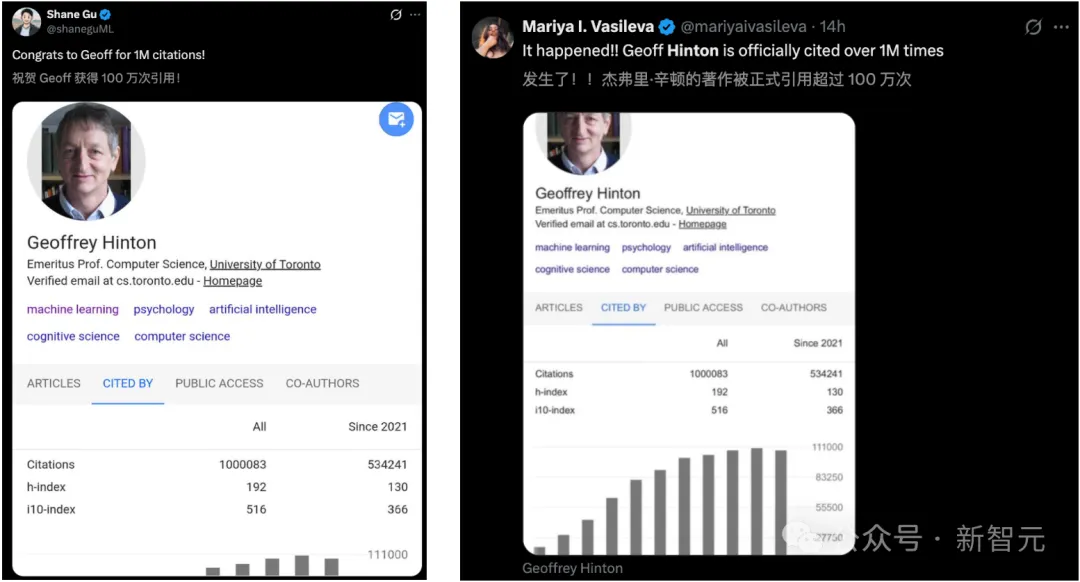

一时间,学术界的大牛们,纷纷为Hinton送上了祝贺。

百万被引,世界第二人

两个月前,Nature曾发文:Bengio成为世界首位被引数超100万的研究者。

这一纪录被很多人视作AI时代的学术注脚。

目前,谷歌学术显示,Bengio被引次数已达到103.6万!

如今,Hinton被引数迅速突破百万门槛,更像是同一条浪潮的回声:

深度学习的核心理论与方法,正在被前所未有的研究规模「持续引用、持续放大」。

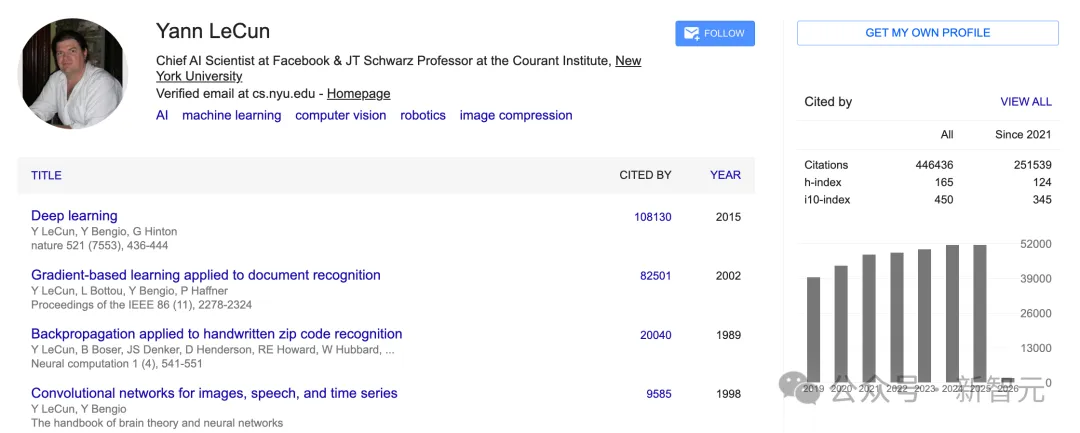

不仅如此,同为图灵奖三巨头的Yann LeCun的被引数也达到了恐怖的45万级。

传奇仍在续写

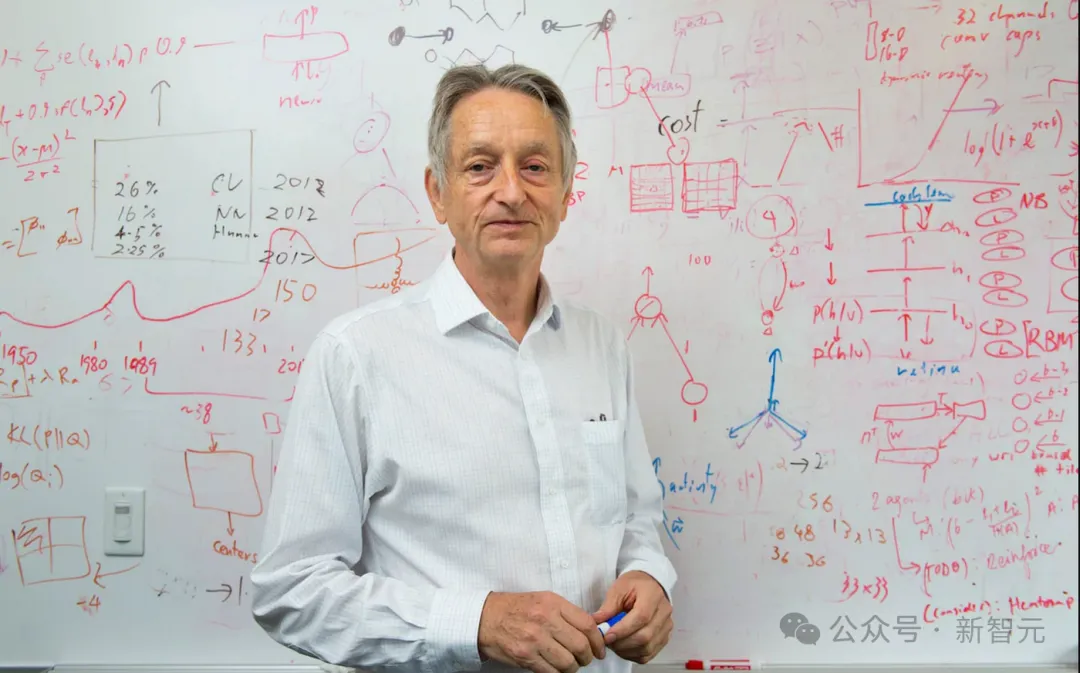

这一成就,植根于Hinton数十年来持续不断的学术积淀。

可以说,读懂他的全部研究,相当于掌握了深度学习的发展脉络与演进史。

Hinton的代表作列表,会有一种强烈的既视感,其中有几篇「时代级论文」的引用数格外醒目:

AlexNet(ImageNet 2012):18万+引用,深度学习大规模视觉突破的重要标志

AlexNet让神经网络第一次以压倒性优势赢下大规模视觉竞赛,直接点燃了深度学习在工业界的信心。

更重要的是,它把「数据+GPU+端到端训练」的路线写成了可复用的范式,从此视觉、语音、推荐都开始沿着同一套工程逻辑加速迭代。

Deep Learning(Nature 2015):10万+引用,三巨头合著,成为无数论文的共同起点

Deep Learning更像一本「统一语言的说明书」,把分散在不同子领域的研究线索串成框架:

神经网络为什么能学、怎么训练、能解决什么问题、还缺什么关键环节。

t-SNE可视化(2008):6万+引用,直到今天仍是科研可视化的常用工具

t-SNE改变了研究者理解模型的方式,比如高维特征怎么分簇、类别边界怎么形成、错误样本为什么混在一起。