4年12篇核心突破——LeCun重构AI表征学习?深蓝AI

「读懂LeCun的“世界模型”」

AI的“世界认知”能力,正在被JEPA改写?

时至今日,“自监督学习”仍是AI领域的核心赛道,而LeCun团队主推的JEPA(联合嵌入预测架构),无疑是近两年最具颠覆性的技术方向——它跳出生成式重建、对比式学习的传统框架,用“潜空间预测”为AI搭建起理解世界的全新路径。

从图像到视频,从语言到机器人,JEPA正在快速渗透多模态领域,成为通用AI的“表征引擎”。它的崛起并非偶然,而是LeCun团队对“AI如何高效学习世界模型”这一核心问题的持续探索。

本文将梳理2022–2026年JEPA的关键突破与技术演进,看这套架构如何从实验室的理论草图,逐步成长为横跨多模态、赋能机器人规划的通用范式。

JEPA为什么能颠覆传统?

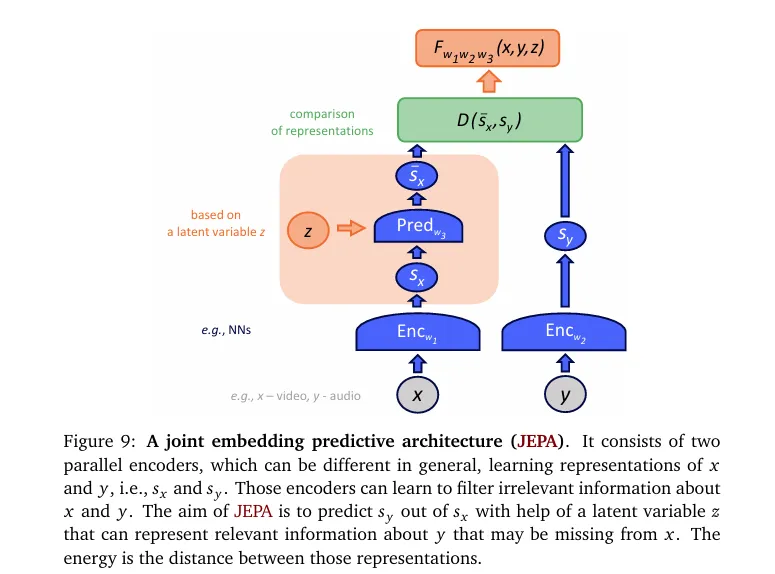

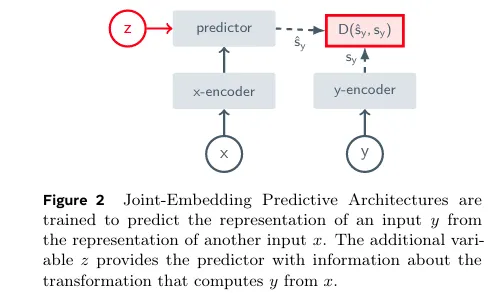

JEPA,全称Joint Embedding Predictive Architecture,即联合嵌入预测架构,其核心使命与传统自监督方法截然不同:放弃像素/Token级重建,专注于抽象表征空间的预测学习。

你可以把它理解为——传统AI学习“复刻细节”(比如生成相似图片、预测下一个词),而JEPA学习“把握本质”:给模型一段上下文信息,让它预测缺失部分的抽象特征,迫使模型理解数据的内在规律、动态逻辑与语义关联。

这种设计的优势显而易见:摆脱对数据增强的依赖、避免表征坍缩、高效学习可预测、可操控的世界模型,而这些正是通向通用AI的关键。从视觉理解到语言建模,从语音处理到机器人规划,只要涉及“从数据中提炼核心规律”,JEPA都能发挥核心作用。

接下来,我们将以年度为轴,拆解JEPA如何从早期探索,逐步覆盖多模态、落地真实场景。

JEPA的逐年进化路径

2022:JEPA初现——离线场景的首次验证

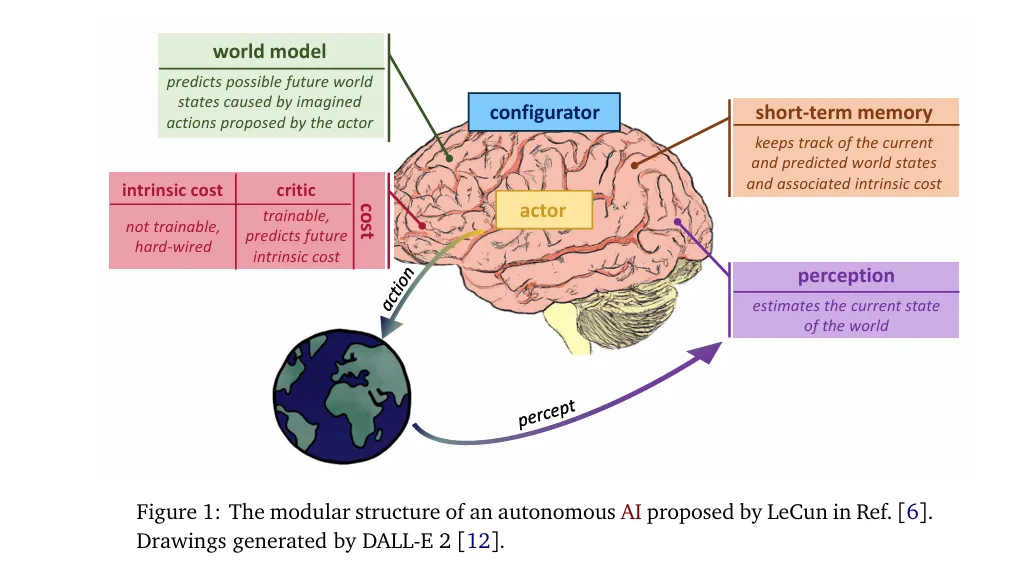

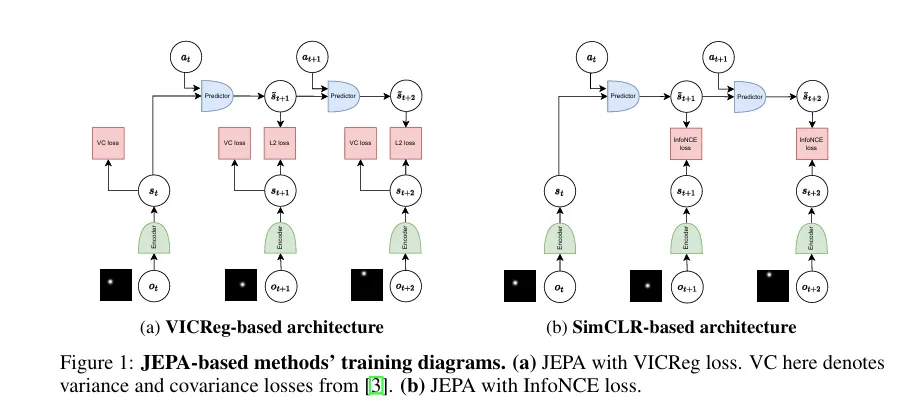

JEPA 的核心架构思路由杨立昆于 2022 年 6 月在《A Path Towards Autonomous Machine Intelligence》中正式提出,而 LeCun 团队于 NeurIPS 2022 发表的短篇研究 ¹(arXiv:2211.10831),是 JEPA 提出后首批实证验证工作。

该研究在 “移动点 + 干扰背景” 的简单环境中,聚焦无奖励、全离线场景,对比了搭配 VICReg、SimCLR 目标的 JEPA 与重建式、逆动力学建模等方法的性能。结果显示:当干扰噪声逐帧变化时,JEPA 表现持平甚至优于重建式方法,但在固定噪声下会因聚焦 “慢特征”(静态干扰)而忽略目标 —— 这一发现既验证了 JEPA “重建无关” 设计的可行性,也明确了其早期短板,为后续 HJEPA(层次化 JEPA)等优化方向提供了关键依据。

这一阶段的工作虽偏向基础验证,但为 JEPA 从理论框架走向实际落地提供了重要的实证支撑。

2023:理论奠基与图像落地——I-JEPA与H-JEPA的双重突破

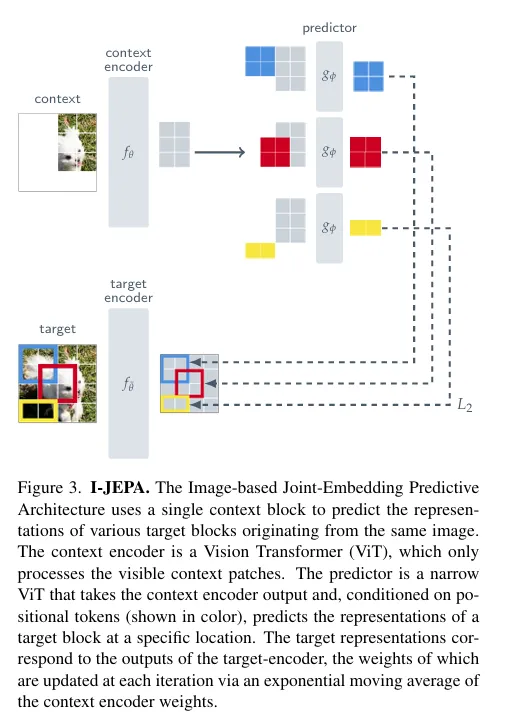

2023年是JEPA的“范式确立年”,两篇核心论文分别从理论与工程层面,为JEPA搭建起完整框架。

年初,ICCV论文I-JEPA²(arXiv:2301.08243)横空出世,成为图像JEPA的奠基之作。它提出了 JEPA 的经典设计范式:用 “大尺度语义目标块 + 空间分布式上下文块”,从单张图像中预测缺失块的表征,彻底摆脱对数据增强的依赖。基于 ViT-Huge/14 训练,I-JEPA 在 ImageNet 下游任务中表现优异,不仅线性探测、半监督学习等任务性能超越同期方法,还以更少训练 epochs 实现更高效率,充分证明了 JEPA 在视觉表征学习中的潜力。该项工作因此被CVPR2023接收。

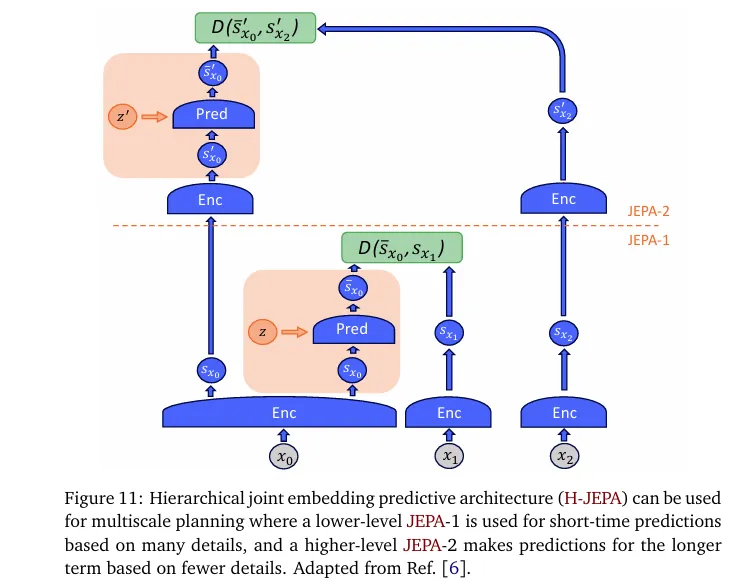

年中,LeCun团队发表H-JEPA综述³(arXiv:2306.02572),为JEPA构建了统一理论框架。论文将能量模型、潜变量模型与JEPA结合,提出“分层联合嵌入预测架构”,明确JEPA的核心目标是学习“抽象、可预测、可操控”的世界模型——这篇综述堪称JEPA的“理论纲领”,为后续所有变种(V-JEPA/LLM-JEPA)提供了底层逻辑支撑。

至此,JEPA完成了“理论+工程”的双重闭环,正式从学术概念走向可复用的技术框架。

2024:视频拓展与泛化升级——V-JEPA开启动态表征学习

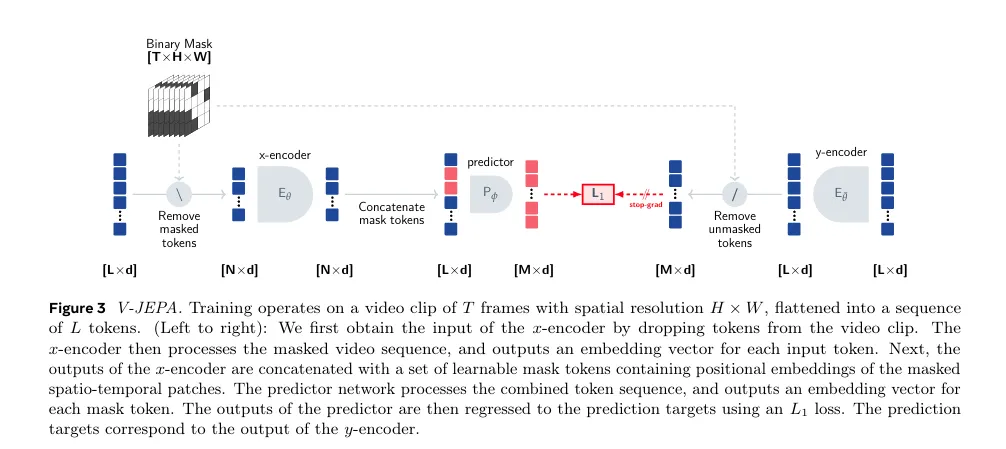

在图像领域验证可行性后,JEPA的探索重点转向动态场景——视频表征学习。2024年的V-JEPA⁴(arXiv:2404.08471)成为这一方向的里程碑。

V-JEPA首次实现“纯视频自监督学习”:不依赖图像预训练、文本辅助或负样本,仅用200万段视频训练,通过预测跨帧特征表征,同时掌握“外观内容”与“运动动态”。其最大模型ViT-H/16在Kinetics-400(81.9%)、ImageNet1K(77.9%)等图像/视频任务中同步达到SOTA,证明JEPA能高效捕捉时序与空间双重信息。