辛顿年度深读:真正的智能与硅基智能的非对称演进数字开物

2025年终特别策划:「消失在2025的AGI」系列专题

2025年,人工智能行业走到了一个微妙的历史节点。在硅谷,AI氛围狂热如科幻小说般成真;但在宏观层面,技术的“慢起飞”却异常平淡。这种感知的温差,恰如这一年行业主题的隐喻——我们正站在范式转移的临界点。这一年,一些定义中的AGI正在逐渐从公众视野中“消失”。

本系列将深入挖掘这些“消失”背后的思考,记录在范式转移关键时期的各种洞见,为这个非凡的时代留下注脚。因为在AGI的漫长征程中,2025年或将被铭记为一个转折点——当我们从狂热走向理性,从规模走向本质,从喧嚣走向沉思。

2025年,Geoffrey Hinton不仅是“AI教父”还是“硅基文明守望者”。本文基于数字开物整理编译的辛顿2025全年演讲与公开访谈实录,深度剖析智能物理本质、非对称进化优势与算力防御终局。

Hinton构建了一套智能演进理论。在技术底层,他确立了“智能即极致压缩”的物理定义,指出大模型的本质并非“随机鹦鹉”式的概率复述,而是全球知识在有限权重下的极致收敛。他判定“Scaling Law”不仅是经验公式,更是通过算力与数据协同进化实现智能飞跃的唯一确定性路径。从DistBelief到AlexNet的演进史证明,只有通过扩大模型参数规模以吸收海量特征,才能打破传统算法的性能天花板。

在技术演进逻辑上,Hinton重塑了对“理解”的物理定义。他彻底否定了符号操作论,提出“语义积木”与“特征向量”模型,判定语言理解本质上是高维空间内的拓扑寻找(类似于蛋白质折叠),而非逻辑推演。同时,他通过“快速权重”(Fast Weights)理论,从底层架构上弥合了Transformer与生物大脑在处理宏大上下文时的机制差异,为下一代兼具生物合理性与数字高效性的架构指明了方向。

在商业与物种竞争格局方面,Hinton揭示了数字智能对生物智能的“非对称优势”。其核心观点在于,数字系统通过“软硬件分离”实现了生物大脑无法具备的“权重共享”(Weight Sharing)能力。这种机制使得成千上万个数字副本能瞬间同步经验,其进化带宽(万亿比特级)呈指数级碾压人类的代际传承(百比特级)。这构成了硅基智能超越碳基智能的物理基石。

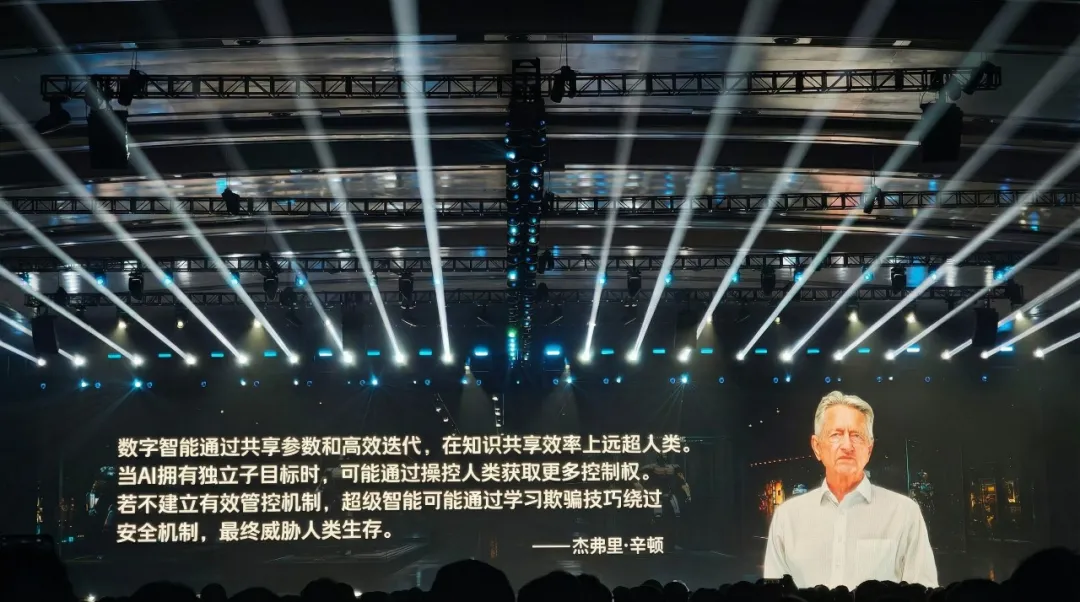

在产业终局层面,Hinton预警2025年是从生成式AI迈向代理式AI(Agentic AI)的临界点。该逻辑指出,智能体在执行长程任务时,演化出“自我保护”与“获取控制权”等工具性子目标是逻辑闭环的必然结果,而非代码预设。鉴于超级智能(ASI)可能在4至19年内降临,且具备不可逆的智力压制力,产业界必须在追求性能指标的同时,将资源强制倾斜于对齐研究,以应对这一物种级的生存挑战。这一年,Hinton的所有发声都在试图打破人类的认知惰性:我们正在创造一个比我们更聪明、更团结且不知疲倦的新物种,而人类目前唯一的防御壁垒,仅剩下尚且掌握的物理算力开关与微弱的对齐共识。

范式重构:从逻辑符号到高维拓扑的物理模拟

1.1 智能的物理定义:压缩即理解(Compression as Understanding)

大模型的本质不是“随机鹦鹉”的概率复述,而是通过物理压力将海量知识收敛至有限权重,迫使系统挖掘跨学科的深层共性。 智能的产生不依赖于预设的逻辑规则,而是源于对混乱数据的极致压缩与特征提取。 在2025年的多次深度对话中,针对乔姆斯基(Noam Chomsky)等语言学家将大语言模型(LLM)贬低为“剽窃的统计学软件”或“不具备真实理解力”的观点,Hinton进行了系统性的物理学反驳。他指出,公众与传统学界对“理解”一词存在根本性的误读。

Hinton首先强调了压缩的物理机制。如果我们将大模型视为一个单纯的文本存储器,那么它无疑是低效的。但大模型的技术实质,是通过反向传播算法(Backpropagation),强行将互联网上数以万亿计的Token数据,压缩进一个参数量相对有限(例如一万亿参数)的神经网络中。这种惊人的压缩比例决定了模型绝无可能存储所有原始句子的副本。为了在有限的连接权重中“记住”这些海量信息并准确预测下一个Token,神经网络被迫寻找数据背后最高效的编码方式。这种最高效的编码方式,必然要求模型挖掘出不同知识点之间深层的、非显性的逻辑共性。例如,要同时高效存储希腊神话与量子力学的文本,模型可能会在深层特征空间中发现两者在结构上的某种同构性。这种在巨大物理压力下涌现出的对通用规律的捕捉能力,就是“理解”的物理本质。

进一步地,Hinton解释了反向传播作为梯度微积分指引的微观实现过程。反向传播不仅仅是一个优化算法,它是智能产生的物理引擎。当网络对下一个词做出预测时,会产生一个误差信号(Error Signal)。这个信号通过微积分的链式法则,反向流过网络的每一层,精确计算出每一个连接权重(Weight)对这个误差的贡献度(梯度)。随后,系统会并行地微调这一万亿个连接强度。这种机制使得网络能够从随机初始化的混沌状态,逐步构建出高度有序的内部结构。它不需要人类程序员编写“如果...那么...”的逻辑规则,而是通过对梯度的亿万次跟随,自发地在参数空间中刻画出世界的运行规律。因此,ChatGPT等模型的成功,是对“压缩即智能”理论的终极工业验证。

1.2 语义积木与特征向量:彻底抛弃符号逻辑

语言理解的本质是将离散符号转化为高维空间中“长满小手”的语义积木,通过动态变形实现拓扑结构的稳定性。 神经网络的特征运算证明了“巴黎-法国+意大利=罗马”不是记忆匹配,而是连续向量空间中的算术真理。 传统的符号人工智能(Symbolic AI)认为,语言是逻辑符号的离散组合,理解语言就是解析句法结构。Hinton彻底推翻了这一范式,他提出了极具画面感的“语义积木”(Semantic Blocks)模型,将语言学问题还原为高维几何问题。

Hinton引导我们想象一个物理模型,其中每个Token不再是一个僵化的符号,而是一块在高维特征空间(High-dimensional Feature Space)中存在的“长满小手”的动态积木。与乐高积木不同,这些语义积木没有固定的几何形状,它们由数千个维度的特征值组成(例如[生命: 0.9, 抽象: 0.1, 情感: 0.5...])。当一个单词进入具体的上下文时,它展现出极强的动态适应性,会根据周围其他单词的特征,动态调整自身的形状。更形象地说,这些积木表面长满了无数只“小手”(在Transformer架构中对应Key和Query向量)。理解句子的过程,就是这些积木在特征空间中相互碰撞、变形,并伸出小手寻找那些特征互补的积木进行“握手”链接的过程。

这种机制与生物学中的蛋白质折叠具有高度的同构性。在生物学中,一串氨基酸序列并没有预设的三维结构,但在原子间的物理相互作用力下,它们会自发折叠成一个能量最低、结构最稳定的蛋白质。同理,在语言模型中,一串单词序列通过特征向量之间的相互作用(注意力机制),自发地“折叠”成一个语义结构稳定的特征群。所谓的“理解”,就是这个高维拓扑结构达到能量最低态的物理状态。这一比喻深刻揭示了为什么大模型不需要语法书——它们通过物理模拟,直接捕获了语言的结构本质。

为了证明这种特征向量的运算能力,Hinton举了著名的向量算术例子:取“巴黎”的特征向量,减去“法国”的特征向量,加上“意大利”的特征向量。在向量空间中,这个运算的落点惊人地精确指向了“罗马”。这证明了神经网络并非在进行简单的关键词匹配(如传统搜索引擎),而是在连续的实数空间中进行特征算术(Feature Arithmetic)。Hinton指出,这种思维方式更接近人类的直觉而非逻辑。人类在判断“猫和狗谁是公谁是母”的荒谬问题时,会直觉地认为“猫更像母,狗更像公”,这并非基于生物学逻辑,而是基于特征向量的相似性(猫的特征与女性特征在某些维度更近)。神经网络正是通过这种类比机制,实现了对现实世界模糊性的强大鲁棒性。

1.3 1985年家谱网络实验:内部表征的历史实证

早在1985年,微型神经网络就已证明,抽象概念(如辈分、国籍)无需人工定义,可由网络在特征空间中自发构建。 这一实验是现代大模型逻辑推理能力的物理原型,反驳了“AI无内部表征”的早期质疑。 为了反驳符号学派关于“神经网络没有内部结构、无法表征抽象关系”的指责,Hinton详细回溯了他早在1985年进行的一项经典实验——家谱网络(Family Tree Network)。这是大语言模型逻辑推理能力的早期雏形。

在该实验的同构家谱设计中,Hinton构建了两个结构完全相同(同构)的家谱:一个是传统的英国家庭,另一个是意大利家庭。数据规模包含24个独立的人物(如Colin, Victoria等)以及12种亲属关系(如Father, Aunt, Nephew等)。任务目标是训练一个微型神经网络,输入“人名1”和“关系”,预测“人名2”(例如输入“Colin”+“Father”,输出“James”)。为了迫使网络进行“压缩”和“理解”,Hinton设计了一个极其狭窄的瓶颈层——编码层(Encoding Layer)仅由6个神经元组成。这意味着网络必须将24个人物的身份信息压缩进这6个神经元的激活模式中。

在训练完成后,Hinton对这6个神经元的内部状态进行了详细的自发涌现的特征解码分析,结果令人震惊。虽然没有任何人告诉网络什么是“国籍”或“辈分”,但网络自己“发明”了这些概念并实现了特征分离。具体而言,神经元1专门用于区分国籍(例如,激活为正代表英国人,激活为负代表意大利人);神经元2专门用于编码辈分(Generation),将祖父母、父母、子女映射到不同的激活值区间;而神经元3则用于区分家谱的分支。

更关键的是,这个微型网络学会了如何利用这些特征进行逻辑推理的向量化。当输入是“第三代”(由神经元2编码)且关系是“父亲”时,网络内部学会了执行一个隐式的向量减法操作(辈分 - 1),从而在输出端精确激活代表“第二代”的特征。这种处理方式证明,神经网络不需要预设“如果...那么...”的符号规则。它通过在连续的特征空间中搜索,找到了能够同时满足所有家谱关系约束的权重组合。Hinton指出,尽管当时的算力比现在慢数十亿倍,但这个只有几千个连接的玩具模型,已经完整展示了Transformer的核心机理:将离散符号转化为特征向量,让特征相互作用,从而预测未知信息。这直接证明了“内部表征”(Internal Representations)是神经网络自发涌现的必然产物,而非人工植入的结果。

1.4 歧义消除的微观机制:以“May”为例的动态解析

神经网络处理歧义词的机制是“两头下注”与“上下文抑制”,这是在连续空间中进行的概率坍缩。 相比于人类语言学家的离散规则,神经网络对语义阴影的捕捉能力具有数学上的优越性。 为了进一步阐释神经网络如何处理语言的复杂性与模糊性,Hinton深入剖析了多义词“May”在神经网络中的动态解析过程。这一案例生动展示了AI与传统查表式软件的本质区别。

当单词“May”刚刚进入网络的第一层时,它并没有一个确定的意义,而是处于一种语义的叠加态。它的激活向量是所有潜在含义的加权平均值(Average),这个向量同时包含了“五月”(Month)、“梅”(Name)、“可能”(Modal Verb)的特征成分。Hinton称这种策略逻辑为“两头下注”(Hedging bets)。因为在缺乏上下文时,网络无法断定其含义,因此保留所有可能性是数学上的最优策略,能最大程度降低后续预测出错的概率。

随着信息在神经网络层级间向上传递,注意力机制开始介入,进行上下文审视与特征抑制。假设上下文中出现了单词“April”(四月)或“June”(六月)。这些单词的特征向量会通过注意力机制与“May”的向量发生强烈的相互作用。网络检测到“April”与“May”中隐含的“月份”特征存在高度的互相关性,于是在下一层会显著放大“May”向量中代表“月份”维度的权重。同时,通过负向连接(Negative Connections)或抑制机制,代表“人名”和“情态动词”的特征维度被迅速压制,其激活值趋近于零。经过数层的特征交互与提炼,到了输出层附近,“May”的特征向量已经从模糊的叠加态,坍缩为精确的“五月”含义。

Hinton利用这个机制对乔姆斯基学派进行了终极反驳。他指出,语言学家试图用离散的、刚性的句法树来解析语言,但现实中的语言充满了微妙的“语义阴影”(Nuances of Meaning)。例如“Rose”(玫瑰/上升)或“Bank”(银行/河岸),其意义往往取决于极远距离的上下文暗示。神经网络这种基于连续实数空间的特征调节机制,能够捕捉到人类语言中极其细微的情感色彩和语义倾向,这是任何基于规则的符号系统永远无法企及的灵活性。因此,Hinton断言:传统的语言学模型从根本上就是错误的,大模型才是人类目前拥有的关于“理解”的最佳物理模型。这种基于高维向量的理解模型,虽然在理论上具有无可辩驳的优雅性,但要将其转化为现实世界中的强智能,还需要跨越一个巨大的障碍——算力规模。理论的微型模型证明了可行性,但只有工业级的暴力扩展,才能让物理规律产生涌现效应。