降智坐实,越聊越傻——Claude终于认了量子位

感谢OpenAI(doge)。

就在GPT-5.5发布的前后脚,Claude招了:

模型降智属实,所有使用额度均已重置。

嘴硬了一个多月,这降智bug终于从A社自己嘴里蹦出来了:

推理等级偷偷从「高」调成「中」

缓存bug导致每轮对话都清空思考记录

一句25词限制的提示词砸了输出质量

三个bug叠在一起,Claude使用体验全面拉垮。

只能还好说友商今天及时给上了一波压力,教育用户终究不可取。

不过,说归说,更新bug当然是好事。就是这时间也太巧了,GPT-5.5刚发,Claude就开始「认怂」。

难不成是5.5帮忙debug的?

Dario啊,你该不会真的是故意让Claude变笨,好在GPT-5.5放出来的时候找画面的吧?

Bug实锤了,一共三个

先说一句,这已经不是第一次了。

去年8月,Anthropic刚发过一次类似的降智postmortem,当时影响的是Opus 4.0和4.1,官方说辞也是「我们从未有意降低模型质量」。

这次新postmortem的标题叫「A postmortem of three recent issues」。recent,意思也很明白。

不是刚刚,是最近。

之所以「最近」,是因为Claude降智这事儿,社区已经嚷嚷吵了很久了。

十多天前,AMD AI组高级总监Stella Laurenzo就在GitHub上发了一份硬核审计报告,覆盖6852份会话文件、17871个思考块、超过23万次工具调用。

分析结果显示,从2月份开始,模型的推理深度出现了断崖式下滑。

更细节的发现是,Claude开始陷入reasoning loops,而且有明显的倾向去选「最简单的修复」而不是正确的修复。

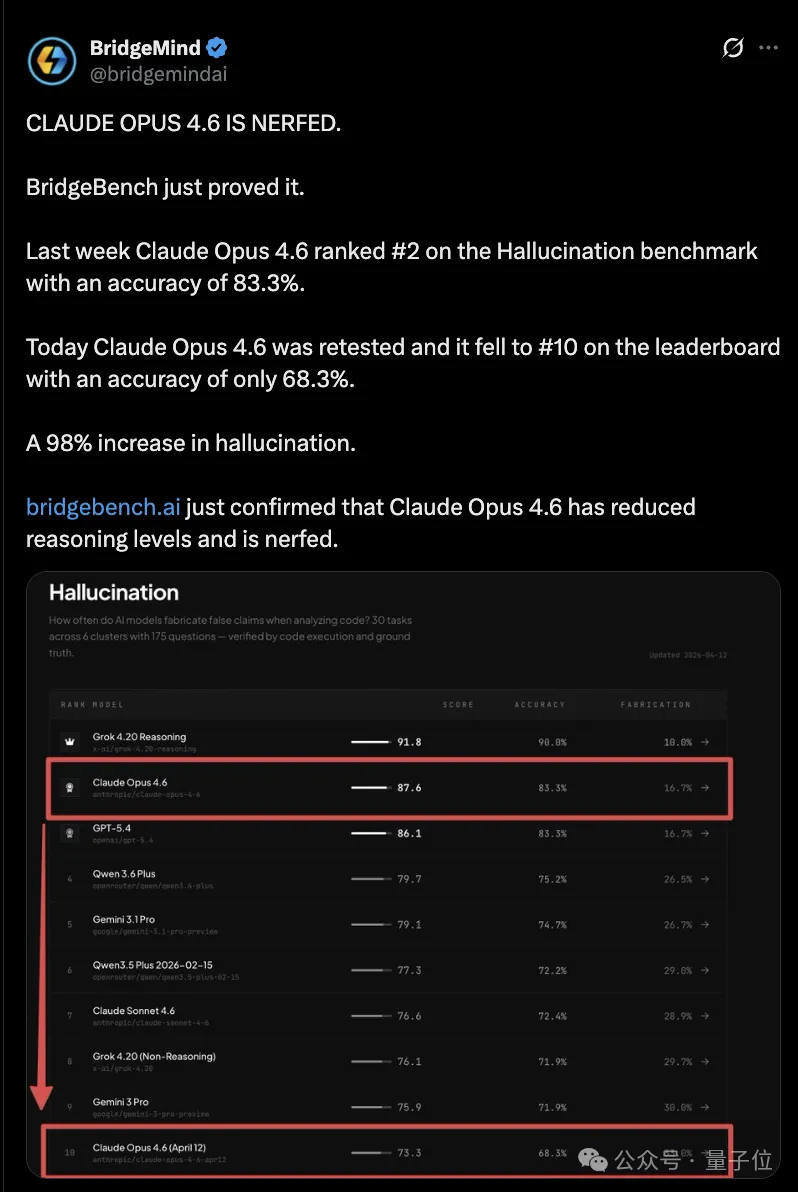

BridgeMind的BridgeBench测试也在同期炸锅,Opus 4.6准确率从83.3%掉到68.3%,排名从第2跌到第10。

虽然后来被研究者批评方法论有问题,前后测试的任务数量根本不一样,但「Claude变蠢了」的叙事已经传开了。

网友甚至造了个新词,AI shrinkflation,AI缩水通胀。同样的价格,你拿到的是稀释过的产品。

换句话说,大伙买到了A社的「儿童套餐」。

但没办法,当时Claude确实是打遍天下无敌手,不少用户边骂边用,没啥脾气。

直到GPT-5.5发了,A社终于坐不住,在官方博客上发了一篇postmortem,把过去两个月的「降智」拆成三条独立问题:

偷偷降了推理等级。

3月4日,Claude Code的默认推理从high调成了medium,理由是high模式下延迟太高。但界面上还是显示「high」。用户以为自己在用满血版,实际拿到的是降档货。一个多月后才回滚。

3月26日上了个缓存优化,本意是会话空闲超过一小时后清掉旧的思考记录。结果代码有bug,清除变成了每一轮都执行。

Claude继续干活,但逐渐忘了自己为什么要干这件事。健忘、重复、工具调用乱飞,就是这个bug的症状。

而且因为思考记录被反复清,每次请求都缓存未命中,token消耗反而飙升。花了15天才修好。

一句提示词砸了输出质量。

4月16日,系统提示里加了一条「工具调用之间文字不超过25个词,最终回复不超过100个词」。

Opus 4.6和4.7都掉了3%性能,四天后回滚。

三个问题影响不同用户群,在不同时间段生效。叠加起来的效果就是整个Claude Code在持续、不均匀地变差,但谁也说不清到底哪里不对。

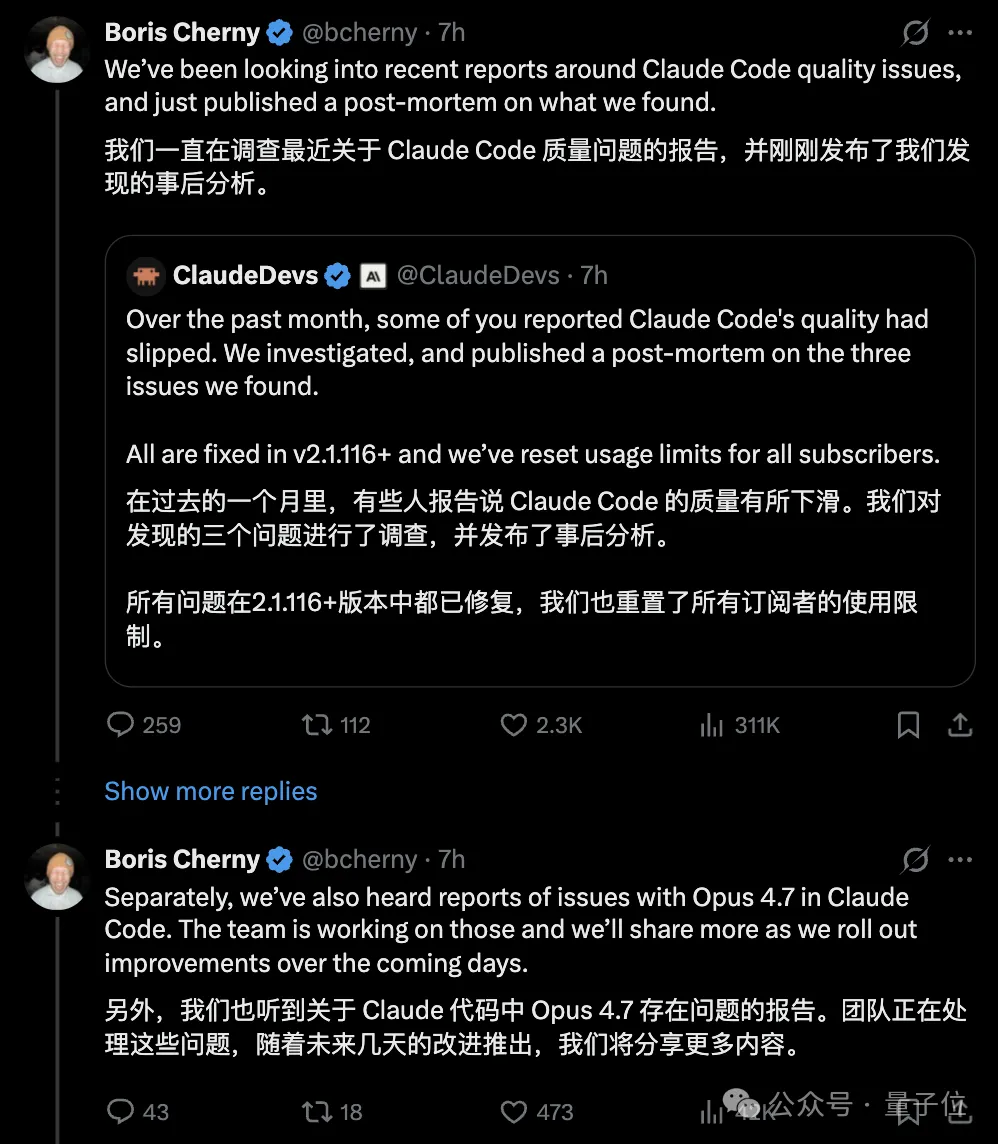

官方推特上,ClaudeDevs发总结,Claude之父Boris Cherny也亲自下场回复,并预告Opus 4.7的bug也正在de了。

但问题是,光有bug不够解释这两个月发生的一切。