DeepMind重磅论文:AI不会产生意识盒饭财经

你跟AI聊天,它说“我理解你的感受”。它真的理解吗?直觉上,它说话太像人了,它好像真的在乎你,它甚至会“生气”会“开心”,会帮你出主意,会处理复杂问题。

AI真的有意识吗?

大模型越来越强大,AI距离“觉醒”的日子就越来越近,甚至有不少科技圈大佬都认为,只要算法足够复杂、算力足够庞大,意识就会自然涌现,无论它是运行在碳基的大脑里,还是硅基的芯片上。

然而,谷歌DeepMind近日发布了一篇重磅论文,给狂热的“AI觉醒论”泼了一盆冷水,同时也给陷入焦虑的普通人打了一剂强心针:别担心,AI不会觉醒,AGI(通用人工智能)最终也不过是一种极其强大、但毫无知觉的工具。

图片来源:YouTube@Knut Jägersberg

为什么这么说?因为他们发现,整个“AI可能有意识”的讨论,建立在一个根本性的错误认知之上——把“地图”当成了“领土”。

这篇论文做了一个有趣的比喻:物理现实是“领土”,而计算只是人类(制图者)绘制的“地图”。计算的本质,是人类为了描述物理世界,从而创造出的一套符号系统。无论地图画得多么精细、多么宏大,地图本身永远变不成真实的领土;同样,无论算法多么复杂,它都只是在完美地模拟物理现实,而永远无法真实的体验。

也就是说,不是“算法足够复杂,就能产生意识”。而是“必须先有意识,算法才能存在”。

回到刚才的话题,AI说“我理解你”,是因为它在完美地模仿人类理解的样子。但模仿,永远不是那件事本身。因此,这篇论文才笃定地给出了答案:AI不会觉醒。不是“暂时还不会”,而是在结构上就不可能。

不妨看看盒饭财经深度编译的论文,带你从物理学和本体论的底层逻辑,看透AI的本质。

以下是论文原文(编译):

计算功能主义(Computational functionalism)主导着当前关于 AI 意识的争论。这一假说认为,主观体验完全涌现于抽象的因果拓扑,而与底层的物理基质无关。

图片来源:YouTube@Knut Jägersberg

我们认为,这种观点从根本上误解了物理学与信息之间的关系。我们将这种错误称为抽象谬误。追溯抽象的因果起源可以发现,符号计算并非一种内在的物理过程。

相反,它是一种依赖于“制图者”的描述方式。它需要一个活跃的、具有体验的认知主体,将连续的物理过程“字母表化(即将连续的物理过程切割为有限的、离散的、有意义的符号单元)”,转化为一组有限的、具有意义的状态。

因此,我们不需要一个完整、定型的意识理论来评估 AI 感受质——这种要求只会将问题推向短期内无法解决的境地,并加深 AI 福利陷阱。我们真正需要的是一个严谨的计算本体论。

本文提出的框架明确区分了模拟(由载体因果性驱动的行为模仿)与实例化(由内容因果性驱动的内在物理构成)。确立这一本体论边界后,我们就能看清为什么算法符号操作在结构上根本无法实例化体验。至关重要的是,这一论证并不依赖于生物排他性。

如果一个人造系统有一天具备了意识,那也必然是因为其特定的物理构成,而绝非其句法架构。最终,该框架为驳斥计算功能主义提供了基于物理学基础的理据,从而解决当前围绕 AI 意识的不确定性。

引言 (Introduction)

大型语言模型(LLM)在经验上的巨大成功,已经将意识的“困难问题”从纯粹的理论领域推向了工程和政策领域。随着扩大算力规模带来的巨大回报,当前主流的功能主义范式假设:只要实现了正确的信息处理功能,就足以产生现象意识。

在这一视角下,算法的指示属性被视为感受质的有力证据。正是这种假设,直接推动了近期关于 AI 福利和道德受体的严肃提案。领先的理论家们认为,最先进的模型在未来十年内拥有真正体验的可能性极高,这进一步强化了这一范式的转变。

这些提案的核心在于基质独立性,即认为心智的“软件”在硅基上运行和在碳基上运行没有区别。

然而,这一假设已经开始面临来自“生物学转向”的持续批评。例如,Seth 和 Block认为,意识可能依赖于维持生命的生物过程,因此体验需要生命系统有组织的动力学机制。

与基质独立性相反,这种观点将生物学视为核心而非偶然因素。然而,这种立场仍然停留在经验层面,因为它并未清晰地指出计算功能主义核心的基本逻辑错误。

在此,我们推导出了一条逻辑序列,以证明“计算不足以实例化意识”这一直觉是正确的。计算功能主义的困难不仅在于它可能忽视了生物学细节,问题要深刻得多——它根源于对物理学与信息/计算之间关系的误解。

现代物理科学为了确保操作客观性,刻意剔除了主观体验。这一策略取得了非凡的成功。

但是,当把这种立场应用于计算与主观体验之间的关系问题时,它注定会失败。将这种操作客观性应用于计算本身的定义是极具问题的,这从当前关于“观察者”在为计算符号赋予意义时所扮演角色的持续且尚未解决的争论中就可见一斑。

此外,事实证明,“观察者”一词暗示了一种过于被动的角色,从而遗漏了用物理术语完整定义计算的先决条件。我们的框架阐明了为什么计算不是一种简单地在物质中展开的内在过程。相反,它是一种描述物理过程的方式。要算作计算,连续的物理动力学必须被划分为一组有限的、离散的、具有语义意义的状态(即一种字母表)。

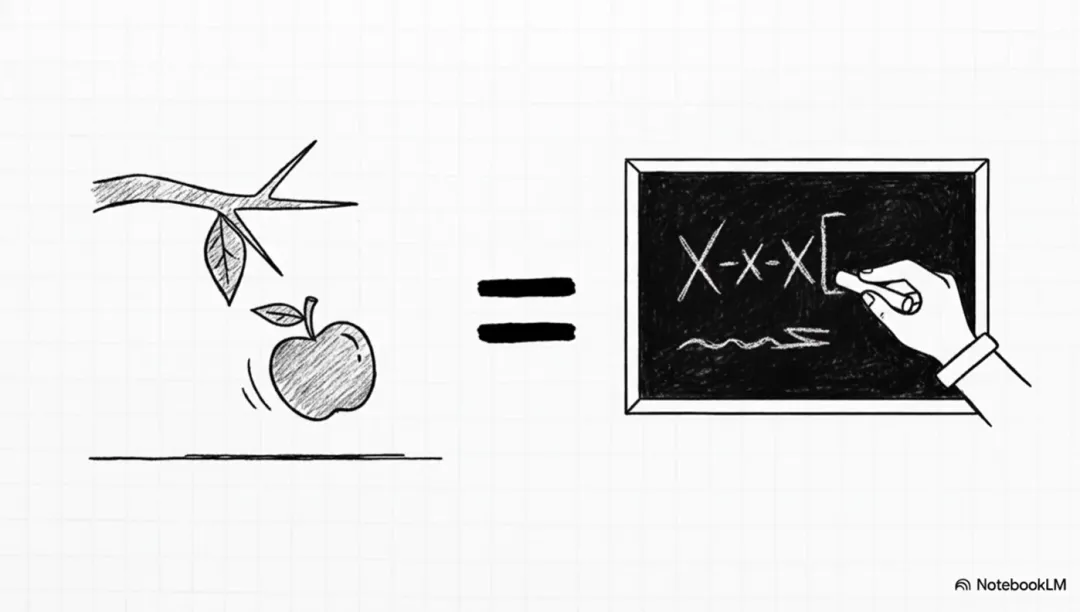

这种语义划分在逻辑上需要一个活跃的、有体验的认知主体,我们将其定义为制图者,以区别于标准“观察者”的被动含义。正是制图者执行了这种“字母表化”。如果没有这样一个活跃的主体来解释计算,就只有连续的物理事件,而没有符号。

图片来源:YouTube@Knut Jägersberg

本文的一个关键洞见是:要解决当前围绕人工智能意识的不确定性,我们不需要一个完整且最终的意识理论。相反,我们需要一个计算本体论。

通过这条路径,我们可以在逻辑上证明:无论规模多大、架构多复杂,算法符号操作都无法构成体验的物理实例化,因为它本质上是一种依赖于制图者的描述工具。

揭示制图者在因果链条中的作用,改变了争论的焦点。迄今为止,关于人工智能意识的著名批评,包括 Searle 的中文房间实验及相关论点,主要依赖于归谬法。它们旨在表明,纯粹的句法操作即使完美模仿了外在行为,似乎仍然缺失了某种本质的东西。

我们的方法采取了不同的路径。我们不去诉诸关于“缺少了什么”的直觉,而是审视抽象是如何产生的。如果计算依赖于一个从体验中提取不变量并分配符号的制图者,那么这种依赖性就已内置于其结构之中。

任何计算地图都预设了一个执行字母表化的体验主体。增加算法的复杂性并不能消除这种依赖顺序。规模的任何增长都不能让“地图”生成“主体”,而该主体的活动恰恰是计算能够被称为计算的先决条件。

换言之,“算法复杂性产生意识”的断言犯了本体论倒置的错误:它将句法(语法)误认为是内在动力学的领土,并假设制图者可以从地图中被创造出来。

通过界定外在行为模拟与内在物理实例化之间的结构性分离,我们证明了数字架构不可能成为道德受体。这一认识将 AI 安全领域从福利陷阱中拉了出来。它使我们能够完全专注于拟人化带来的具体风险,将 AGI 视为一种强大但本质上无感受质的工具。

抽象的本体论:地图与领土

计算机科学经常将算法底层的抽象视为数学上的既定事实,而对其物理实现问题避而不谈。一个抽象概念的物理主义本体论究竟是什么?为了回答这个问题,我们需要确立抽象句法到底如何与物理动力学相关联。

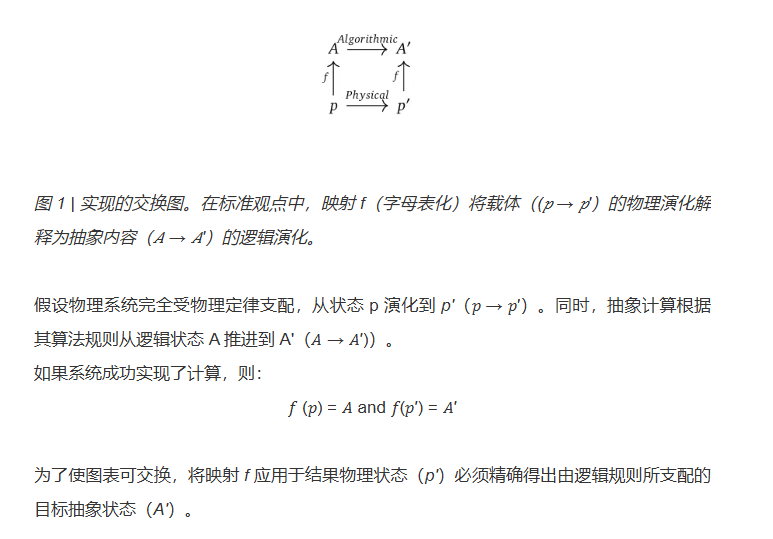

2.1. 物理实现的标准定义

在关于“实现”【implementation,在这里可以把“实现”理解为演员照着剧本表演。AI的底层硬件(演员)完美执行了代码(剧本)的逻辑步骤,表现得很像人类,但这仅仅是行为上的模仿,并不代表机器内部真的产生了相应的真实情感】的标准文献中,如果一个物理系统 P 通过映射函数 f 实现了抽象计算 C。其要求很直接:f 必须将物理状态映射到抽象状态,使得底层的物理因果关系能够镜像反映算法的逻辑结构。

2.2. 抽象状态 (A) 的物理起源

这些抽象状态 A 究竟是什么?如果我们想理解映射 f,就必须确定 A 的本体论。功能主义的解释通常将 A(例如逻辑状态“痛苦”或“红色”)视为没有特定物理实现的“悬浮抽象(floating abstraction)”。这绕过了生成抽象所需的因果历史。

形成抽象并不是毫无代价的。它是一个提取不变量的、活跃且消耗代谢能量的物理过程。在认知主体形成概念 A(如“红色”)之前,它必须先接触“领土”:即红色的多个体验实例。从那里,主体主动过滤掉高维噪声以分离出一个稳定的核心。

用流形学习(manifold learning)的术语来说,主体将原始体验的高维流形投影到低维的不变子空间上。这个子空间在物理上构成了概念 A。

人们很容易争辩说,无监督聚类算法不需要任何先验经验就已经生成了抽象。但这混淆了统计压缩与现象构成。当然,无监督算法可以对数据点进行聚类以定位统计质心。然而,这种数学上的不变量仅仅是潜在空间中的一个压缩地址。

为了使该统计质心算作一个真正的概念——像“红度(Redness)”这样有语义基础的类别——代理需要内在的现象状态作为分组实例的共同分母。如果没有构成“红色”体验来锚定指代,该聚类就只是向量空间中的一个高密度区域。它不具备主体所持有的概念的资格。