特斯拉开源硬件,中国回应:把机器人大脑开源吧量子位

特斯拉开源硬件专利后,所有人都在等:中国公司怎么回应?

现在答案来了——跟风硬件没意思,要开源就找比硬件更值钱的东西。

4月22日,智平方发布AlphaBrain Platform开源社区。这是全球首个一站式、开箱即用的具身智能模型开源社区。

注意,这次不是单模型开源,智平方联合港科大(广州)熊辉团队直接拿出了一套“顶配全家桶”:

具身前沿技术(类脑/世界模型)

最全架构覆盖(RL/传统VLA/类脑)

最自由组合能力(跨范式即插即用)

最公平评估标准(统一Benchmark)

最广泛开发社群(汇聚全球产学研开源力量)

这些原本只存在于顶尖实验室的前沿技术,现在全部开放!任你取用!

有开发者评价:

以前开源是给你一个工具,现在开源是直接给你一个工具箱。

2023年成立的智平方,专注AGI原生的通用智能机器人,目前公司规模近300人。

因一年12次融资,该公司被外界称为全球具身智能领域融资节奏最快的独角兽。摩根士丹利也把它列为具身基础模型的代表企业。

此时拿出这样一套“工具箱”,智平方有什么考量?

过去两年,具身智能涌现了大量开源模型。但一个尴尬的现实是:开源模型很多,真正“好用”的很少。

开发者还是要面对各种问题:这个模型怎么跑起来?那个模型跟它比谁更强?我想做的创新能不能落地到真实场景?

现在,AlphaBrain Platform选择开源“让模型跑起来、比得清、落得地”的全链路能力,方便复现、方便对比、方便场景化落地。

信号已经很明确了:中国具身智能的开源战,正式进入头部玩家卡位阶段。

5大技术亮点,有3个最值得看

前面说过了,这套“顶配全家桶”集齐了业内五大核心技术。

其中最受关注的,当属世界模型、类脑模型、RL Token和持续学习算法。

它们是当前具身智能领域最火的技术路线,各有各的狠活儿。别急,咱们一个个来看。

世界模型:最火的“想象力引擎”

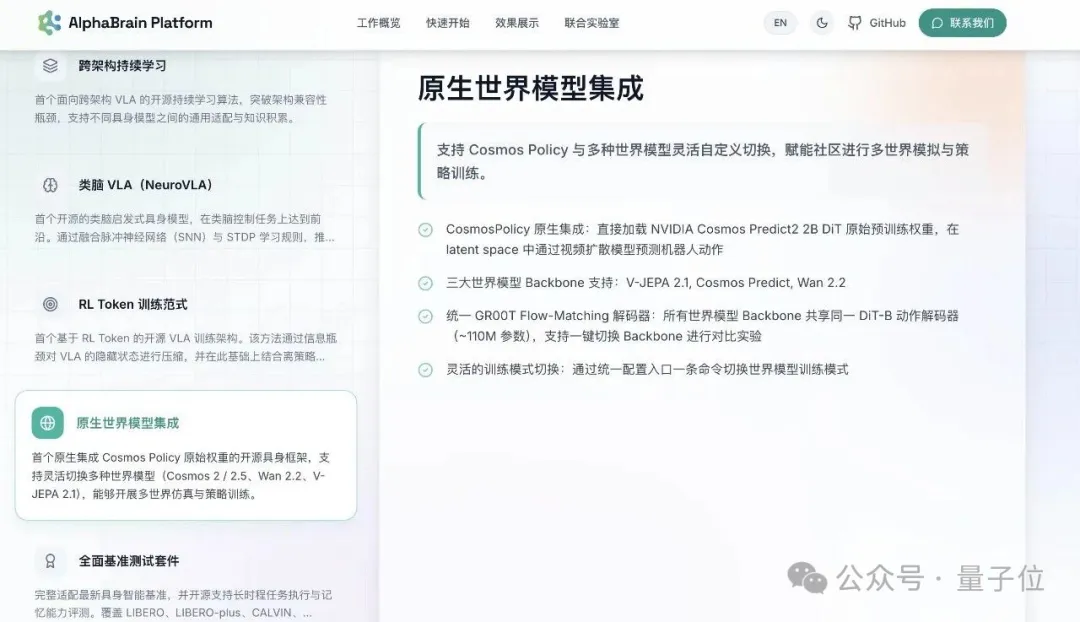

AlphaBrain Platform最硬核的地方,是把世界模型的能力给拉满了,带来了全球首个可插拔世界模型架构(WA)。

亮点有主要有2个:

1、原生集成NVIDIA Cosmos Policy原始权重。

这可不是挂个名头。

开发者可以直接加载NVIDIA Cosmos Predict2那个2B参数的DiT原始预训练权重,在latent space里通过视频扩散模型预测机器人动作。

说白了,就是把NVIDIA最核心的那套“动作预测”能力,原封不动地搬了过来,可训参数约1,956M,这底子打得够厚。

2、预设三大主流世界模型Backbone,自由切换。

Meta的V-JEPA 2.1(约18亿参数),视频联合嵌入预测架构;

NVIDIA自家的Cosmos Predict系列(约21亿参数)世界模型;

通义万相的Wan 2.2(约50亿参数),是这三款中体量最大的一个,主打大规模文本-视频生成。

这阵容拿出来,基本就是把全球顶尖的世界模型一网打尽了。

这三个Backbone可以在Flow-Matching解码器中进行自由切换。

啥意思?就是一个动作解码器(约1.1亿参数),喂给这三个世界模型都能用。

开发者想对比不同世界模型在同一个任务上的表现,一键切换就行了。

训练模式切换也做到了极致简化。

一条命令,就能通过统一配置入口切换训练模式,只需要简单修改配置文件即可运行。

RL Token:强化学习+VLA的黄金组合

智平方自创立起,便确定了构建物理世界大模型的核心技术方向,在行业尚未形成共识前,率先布局VLA架构。这些年对VLA的研究一直没有停下。

在面对VLA结合强化学习的研究方向时,开发者往往要面对两座大山:动辄数十亿参数带来的极低的推理效率的门槛,以及微调时极易引发的“灾难性遗忘”难题。

RL Token则是打破这一僵局的“黄金组合”,也是让大模型真正可落地的场景化利器。

智平方率先在LIBERO环境上完成了该路线的验证,并提出了一套对开发者极其友好的开源优化方案。

这套方案的核心突破在于:

1、信息瓶颈编码与VLA主体冻结

为了解决算力开销和遗忘问题,方案引入了信息瓶颈编码器与两阶段训练策略。

在RL微调阶段,庞大的VLA主体参数被完全冻结。这不仅守住了模型原有的通用能力底线(避免灾难性遗忘),更让训练的计算成本实现了断崖式下降。

2、降低RL的训练门槛

通过架构优化,系统所需训练的参数量从原本庞大的3.9B骤降至约137M(仅占VLA总参数的3.5%)。

更硬核的是,在实际的强化学习梯度更新环节,仅涉及极轻量的1.3M参数。

这意味着,开发者不需要庞大的算力集群,仅需单张普通消费级RTX 4090显卡,就能跑通VLA的强化学习后训练(Post-training)。

3、告别推翻重来,实现“稳定进化”

换句话说,广大开发者可以在不破坏模型原有能力的前提下,对特定任务进行低成本优化。

大模型终于可以像人类一样,在已有的丰富经验基础上不断精进,而不是每次遇到新场景都反复推翻重来。

这套方案证明了强化学习+VLA这对黄金组合,可以让每个行业、每个场景都用它来定制自己的“能干活的AI”。

持续学习:数据洪流下的“不会忘”工程

机器人一旦真实部署,每天都在产生新场景、新任务、新技能。

传统训练模式有个老大难问题——学新的忘旧的,也就是业内公认的“灾难性遗忘”。

要做通用智能机器人,持续学习(Continual Learning,CL)是绕不开的底层能力。

AlphaBrain Platform在这一块做了比较系统的工程化工作:把CL从“单模型上的研究玩具”推向多架构可复现的对比平台。

技术亮点主要有3个:

1、多架构横向对比

当前前沿的VLA架构——QwenGR00T、NeuroVLA、LlamaOFT、PaliGemmaOFT——都被纳入了同一套CL验证流程。

每个架构上都跑了全参与LoRA两种训练变体,形成统一基准下的横向对比,而不是只在某一个backbone上秀单点效果。

2、跨架构解耦:算法和模型互不侵入

CL算法接口和业务模型完全解耦——换backbone成本极低。