印度工人“边打工边教机器人”抢自己饭碗酷玩实验室

最近,一段来自印度南部服装厂的视频在国内外社交平台上疯传。

画面里,流水线上的工人正在低头缝纫,和普通的工厂场景没什么两样,除了一件事——每个人头上都戴着一个摄像头环。

评论区吵成了两派。一派说这是老板在监视员工,抓人摸鱼的新花样;另一派说不对,这是在给机器人喂数据。

两派说法都很地狱,但后者,才是整件事真正让人坐立不安的地方。

01.打工人正在被录像存档

那个戴着摄像头环的工人,正在做的事情有个技术名词,叫采集"Ego 数据",全称是“第一人称视角数据”。

逻辑很简单:把摄像头架在头顶,记录下工人干活时的第一视角,手怎么抬、怎么落、怎么捏住一根线穿过针眼。每一帧画面,都会变成喂给 AI 模型的训练素材。

工人的双手,成了机器人的老师。

亲手教会机器人取代自己。普通人听到这种事会感受到一种生理性的冒犯,但业内对此很兴奋,因为这种方式,实在太!便!宜!了!

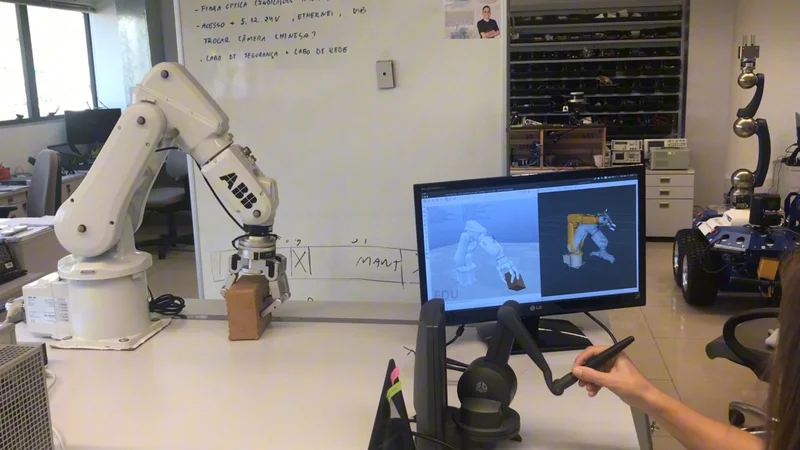

过去,机器人行业训练模型的主流方式叫"真机遥操",听上去很科幻,操作起来其实很笨重:一个工程师戴上 VR 头显,眼前的画面同步到机器人的摄像头视角,然后他要像遥控玩具一样,手把手地控制机器人的每一个动作——拿起这个杯子,放到那个托盘上,再拿起那块布,折叠,放好。整个过程一帧一帧地被录下来,这就是训练数据。

这套方案最大的问题是贵,而且慢。

一台用于数采的机器人本体,动辄几十万。还得配专职的数采员,培训上岗,全程盯着。采集一条高质量的操作数据,可能要耗掉工程师大半天时间,工程师的工资又很高。

Ego 数据方案把这套流程从根上改了:工人戴上头顶的摄像头,绑上腕部的追踪器(有些方案还会配一副特制手套)。换装完毕,正常上工就行。

这三层设备各有分工。头戴摄像头负责记录第一视角的完整画面——操作台的布局、物体的位置、手和目标物之间的空间关系;腕部摄像头对准手部,专门捕捉手在近距离操作时的细节;穿戴手套则完全不依赖视觉,直接用传感器测量每根手指的关节角度。

三层叠加,就还原了一个完整的操作动作——人的眼睛看到了什么、手在哪里、手指该怎么动。通过这些样本,机器人可以学习从视觉到动作的映射关系,即看到某个画面时,应该做些什么。

这里面有一个小 bug,机器人学谁,就像谁。

如果被采集的工人是个熟练工,动作干脆、力道精准,那机器人学出来的就是一套行云流水的操作。可万一这位工人习惯摸鱼,比如拧螺丝前先挠挠头,放零件时要抖两下手腕,甚至一边干活一边东张西望……那机器人也会把这些多余的动作当成标准流程学进去。

所以视频里,整个车间只有一排工人头上戴了摄像头,或许,他们是整个车间选出来的最好的工人。

还有更简单粗暴的方式,是只筛选数据,不筛选人。美国有一家叫做 Generalist AI 的公司,他们用众包的方式,把低成本穿戴设备分发给世界各地的普通人。不管是你在家折衣服、在厨房洗碗,还是在修车铺拧螺丝,只要戴上设备,人人皆可边干活边采数据。

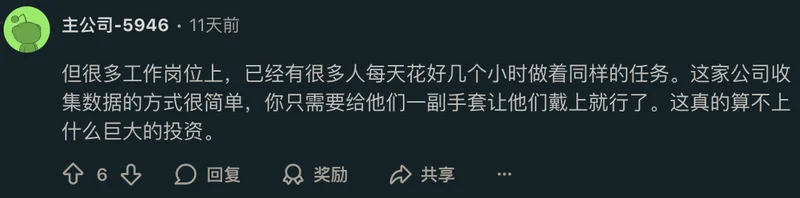

业内对此充满了怀疑,普通人在家里采出来的数据,质量根本没法和专业数采中心比,怎么能训练出高成功率的模型?

答案是大力出奇迹。海量的原始数据进来,系统自动筛选,低质量的直接丢掉,只留下那些三层数据对得上的高置信度样本。数据量足够大,过滤完还剩得够多,就能用。

所以越来越多的数采方案开始强调"轻量化",设备越做越小,目标就是让采集完全融入日常工作,对工人的动作干扰降到零。业内已经有团队在研究把摄像头集成进普通眼镜,手套也在往更轻薄的方向迭代,最终形态可能是一副眼镜加一块手表,穿上就采,看不出来和普通上班有什么区别。

这张采集数据网正在全球快速铺开。硅谷的实验室、东南亚的代工厂、北美的物流分拣中心、欧洲的家庭厨房里,成千上万个传感器正如同毛细血管般伸向人类的日常。这种生意已经催生出了专门的“数据供应商”。比如许多公司正在推广的通用移动接口(UMI)方案,它彻底切断了数据与特定机器人硬件的绑定。有测算显示,这种脱离了昂贵真机、只靠穿戴设备的采集方式,单条数据的生产成本仅为传统方案的五分之一,效率却翻了五倍。

印度工厂那个画面,只是这张大网上,一个最先被普通人看见的节点。

而这种近乎掠夺式的大规模采集,背后折射出的是一个令 AI 巨头们焦虑的真相:机器人没“米”下锅了!

02.机器人也有数据荒

在数字世界里,AI 是衔着金汤勺出生的。

大语言模型的训练素材来自整个互联网。几十年来人类随手丢在网上的文字、代码、新闻、甚至论坛里的废话帖子,对 GPT 们来说都是取之不尽的养分。只要算力足够,AI 能在几天内读完人类几千年的文明。