Intel的人在Synopsys大会上说:你们落后了麟芯说AI

Synopsys Converge 大会上,Synopsys、Intel、AMD、Nvidia、Microsoft 和 UC Berkeley 的六位专家坐在一起,讨论了一个让所有人既兴奋又不安的话题:AI 正在入侵芯片设计的每一个环节,但 EDA 厂商的 agentic AI 方案,离真正可用还差一截。

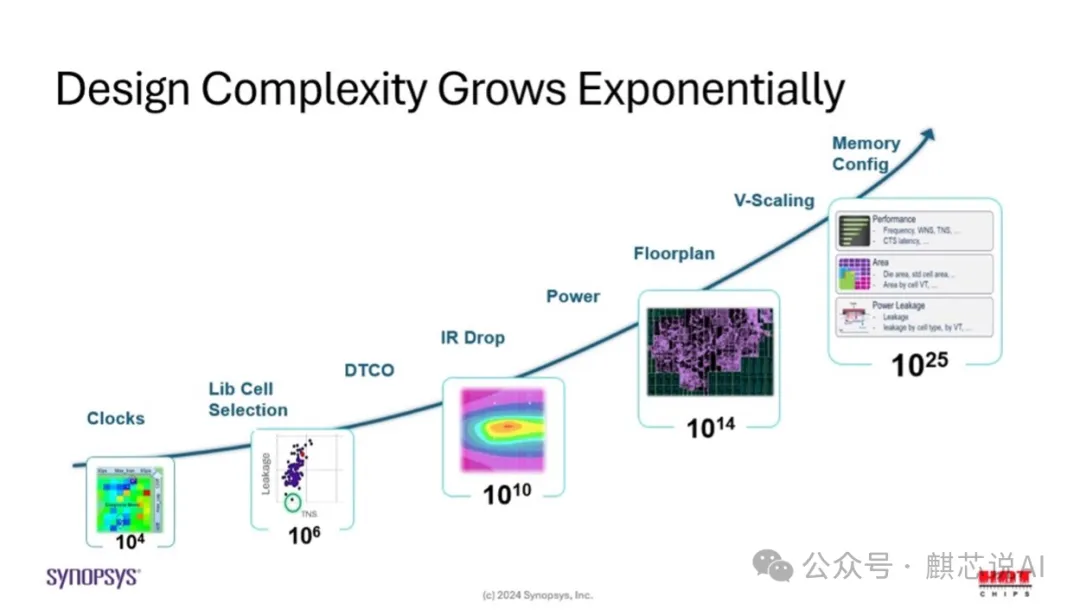

更关键的是,当 AI 推理速度每几个月翻倍时,EDA 仿真工具还在用 CPU 慢慢跑。

EDA 厂商说自己落后了,是真的吗?

SemiEngineering 在 Synopsys Converge 大会现场组织了一场圆桌讨论。阵容不算小——Synopsys AI & ML 副总裁 Thomas Andersen、Intel 模拟/混合信号工具高级总监 Sridhar Boinapally、AMD 企业院士 Alex Starr、Nvidia GPU 硬件工程副总裁 Stuart Oberman、Microsoft 硅工程基础设施合伙人 Silvian Goldenberg,还有 UC Berkeley 教授 Borivoje Nikolic。

这是系列讨论的第二部分,聚焦 AI 对芯片设计和 EDA 工具链的实际影响。

几个核心判断值得注意:

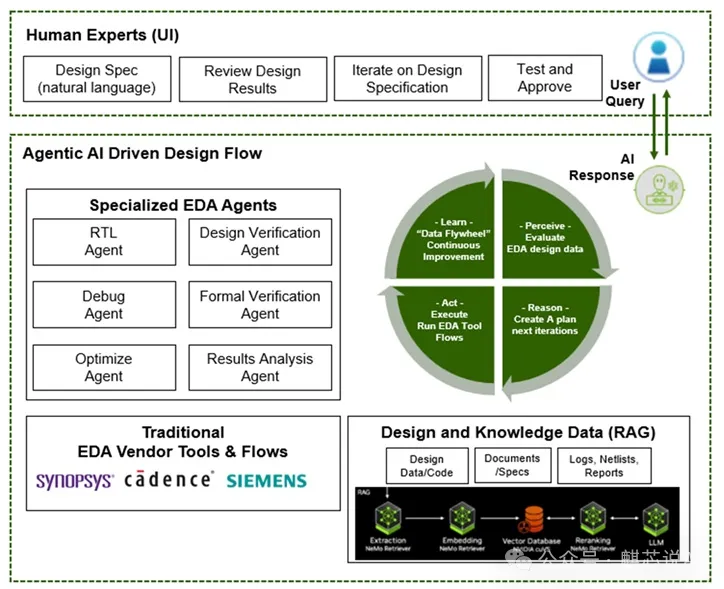

EDA 厂商在 agentic AI 革命中"略微落后"。Intel 的 Boinapally 的原话。传统 EDA 的交付模式是"我给你工具,你自己修问题",但 agentic AI 要求的是基于高层规格自动迭代设计——这在当前的 EDA 体系中还不存在。

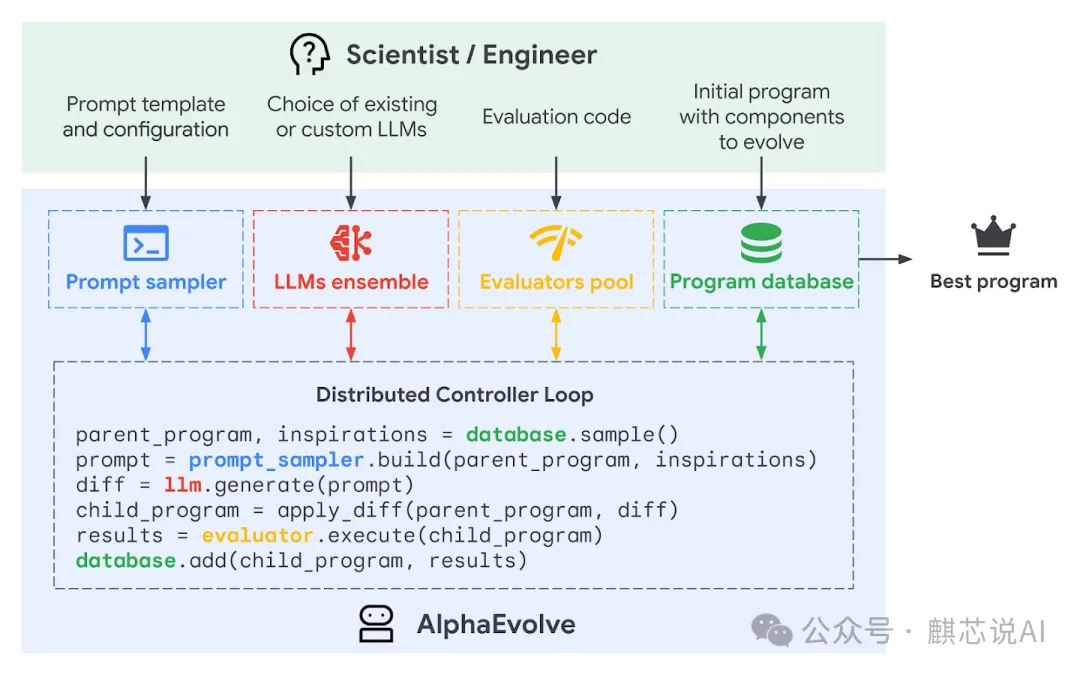

仿真速度是硬瓶颈。Berkeley 的 Nikolic 指出,芯片设计领域没有 surrogate simulation(代理仿真),EDA 工具对 GPU 的存在反应迟缓。Synopsys 的 Andersen 补充说,AlphaEvolve 在 EDA 领域面临的核心问题是 runtime 太长,"未解决的问题"。

芯片设计团队的角色正在模糊化。Microsoft 的 Goldenberg 说得很直白:"过去我开发流程,现在我设计团队,团队自己开发流程做实验。"

从"每瓦性能"到"每吉瓦性能"

Nvidia 的 Oberman 抛出了一个细节:在高性能数据中心,行业已经不再谈"每瓦性能",而是谈"每吉瓦性能"。

不是修辞上的夸张。GB200 NVL72 单个机架功耗超 100 kW,一个数据中心动辄数十万颗 GPU,功耗确实是以吉瓦为单位计算的。能耗尺度放大到这种量级,芯片设计的优化目标必须重新校准。

Oberman 的说法揭示了一个根本变化:过去设计师追求面积效率和单芯片性能,现在追求大规模系统的能耗效率。设计流程、验证方法、EDA 工具的评价标准都需要调整。

EDA 的 agentic 焦虑

"EDA 公司在 agentic AI 革命中略微落后。"

这话出自 Intel 的 Boinapally 之口,分量不小。Synopsys 是全球最大的 EDA 厂商之一,Converge 是他们自己的大会,在这样的场合被直接说"落后了"。

Boinapally 的意思很明确:传统 EDA 的思维模式是工具导向——我给你引擎、能力、算法,你设计师自己想办法用好。但 agentic AI 要求的是另一层抽象:告诉系统"我要一个满足这些规格的设计",系统自己去迭代、调试、优化。

中间差了一大步。

Synopsys 的 Andersen 回应得谨慎。双方都有专业知识——EDA 公司懂工具和算法,芯片公司懂芯片设计流程。未来不是谁替代谁,而是交付机制变了:EDA 厂商不再通过技术支持人员传递知识,而是通过数据库和 AI agent。

但他承认了一个关键事实:今天所有用来训练 agent 的知识都来自人类。工程师告诉 AI 怎么 debug、怎么设流程,然后 AI 学着做。让系统自主发现比人类更好的方案——"目前还不是这样"。

如果 agentic AI 的训练数据全部来自人类的现有做法,那它最多只能做到"自动化已有的最佳实践",无法突破人类经验的天花板。Andersen 说的"自学习系统"才是 agentic AI 的终极形态,但这条路还没走通。

这类 agentic 工作流的质量验证,恰好是 AI+EDA 工具链需要补上的关键一环。IC Agent Hub提供的 Benchmark 质量验证能力,可以对 AI 生成的设计流程进行格式校验、安全扫描和运行验证,确保 agentic 方案落地前经过系统化的质量把关。

仿真速度:被忽视的基础设施瓶颈

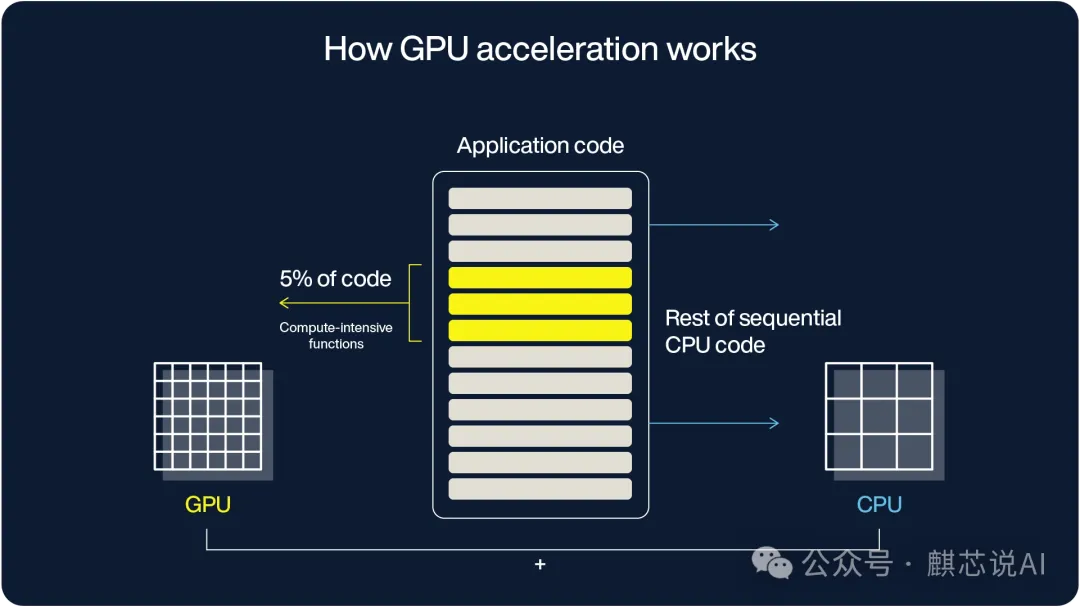

Nikolic 提了一个经常被忽略的问题:EDA 仿真工具的速度,远远落后于 AI 推理的速度。

机器学习领域,GPU 推理已经能在毫秒级完成复杂计算。芯片设计中,仿真工具还在用 CPU 慢慢跑,而且没有 surrogate simulation 来加速。

代理模型在其他工程领域已经很常见——用机器学习训练一个快速近似模型替代慢速高精度仿真。Nikolic 说芯片设计领域没有这个东西,或者说还没有足够准确的 surrogate 被广泛采用。

Andersen 提到 Google 的 AlphaEvolve,Gemini 驱动的编码 agent,能自动优化算法和芯片设计。致命问题是 runtime 太长——一次仿真可能跑几个小时甚至几天,agent 需要反复迭代,时间成本呈指数级放大。

结构性矛盾:AI 的迭代速度受限于 EDA 仿真的物理速度。仿真不加速,agentic AI 的效率就被锁死了。

Synopsys 和 NVIDIA 在 2025 年 10 月宣布的多年期战略合作,NVIDIA 投资 20 亿美元,核心目标之一就是用 CUDA 加速计算和 Omniverse 数字孪生提升仿真速度。GPU 加速全面渗透到 EDA 工具链的话,这个瓶颈有望被打破。

芯片设计团队的重构

讨论中最有意思的部分是设计团队的变化。

AMD 的 Starr 描述了一个场景:工程师拿到 agentic 框架后,第一反应是找"低垂的果实"——能耗分析、常规调试、暴力分析。这些是 agentic AI 最容易切入的场景,规则明确、重复性高。

真正的变化在团队结构层面。

Microsoft 的 Goldenberg 说,团队动态已经发生了根本变化。过去资深工程师开发设计流程,其他人照着用。现在,"我设计团队,团队自己开发流程做实验。"角色边界在模糊——前端设计、后端验证、物理实现之间的传统分工正在被打破。

对芯片公司来说,人才需求在变。纯粹的"工具操作员"价值在下降,能理解 AI 工具、能设计工作流、能把高层需求翻译成 agentic 指令的工程师价值在上升。

Intel 的 Boinapally 说得更直白:"AI 既令人害怕又令人兴奋。"大规模内部培训应对——不是让所有人变成 AI 专家,而是让更多人知道怎么用 AI 工具做本职工作。

差异化 vs 同质化

Andersen 抛了一个值得思考的问题:所有芯片公司都用类似的 agentic AI 工具做设计,最终结果会不会趋同?

比方打得好——好莱坞电影。同样的摄影机、同样的设备,拍出来的电影不一样。但如果 AI 工具强大到能自动发现最优设计方案,"最优解"对所有人都是同一个,差异化从哪里来?

AMD 的 Starr 的回答:每个芯片公司在"AI IQ"和内部基础设施上的位置不同。有的用全套 EDA 厂商的 agentic 方案,有的专注于特定工具的深度优化。差异化的来源从"工具能力"转移到"数据资产"和"领域知识"。

Microsoft 的 Goldenberg 也强调数据:"首先需要好数据。"设计公司积累的历史设计、仿真结果、失效模式、工艺偏差——这些是 agentic AI 训练的核心燃料,也是最难被复制的竞争壁垒。