大事不好,机器人学会预测未来了量子位

不得了,机器人现在开始学会脑补未来了。

这就是蚂蚁灵波又又又又(连续第4天)开源的狠活儿——

全球首个用于通用机器人控制的因果视频-动作世界模型,LingBot-VA。

怎么个脑补法?

简单来说啊,以前的机器人(尤其是基于VLA的)干活儿,主打一个条件反射:眼睛看到什么,手立刻就动一下。

这叫“观察-反应”模式。

但LingBot-VA就不一样了,它通过自回归视频预测打破了这种思考方式,在动手之前,脑子里先把未来几秒的画面推演出来。

说实话,用想象力做决策,在机器人控制这块还是相当新鲜的。

但这不是LingBot-VA唯一的亮点,还包括:

记忆不丢失:做长序列任务(比如做早餐)时,它会记得自己刚才干了什么,状态感知极强。高效泛化:只要给几十个演示样本,它就能适应新任务;换个机器人本体,也能hold住。

因此在LingBot-VA的加持下,像清洗细小的透明试管这种高精度任务,机器人已经是可以轻松拿捏:

正如我们刚才提到的,今天是蚂蚁灵波连续第四天开源。

如果说前几天的开源是给机器人加强了眼睛(LingBot-Depth)、大脑(LingBot-VLA)和世界模拟器(LingBot-World),那么今天的LingBot-VA,就是让这具躯壳真正拥有了灵魂——

一个行动中的世界模型,让想象真正落到执行层面。

如此一来,通用机器人的天花板,算是被蚂蚁灵波往上顶了一截。

正如网友所述:

从预测到执行;说实话这是巨大的飞跃。

让想象力先行一步

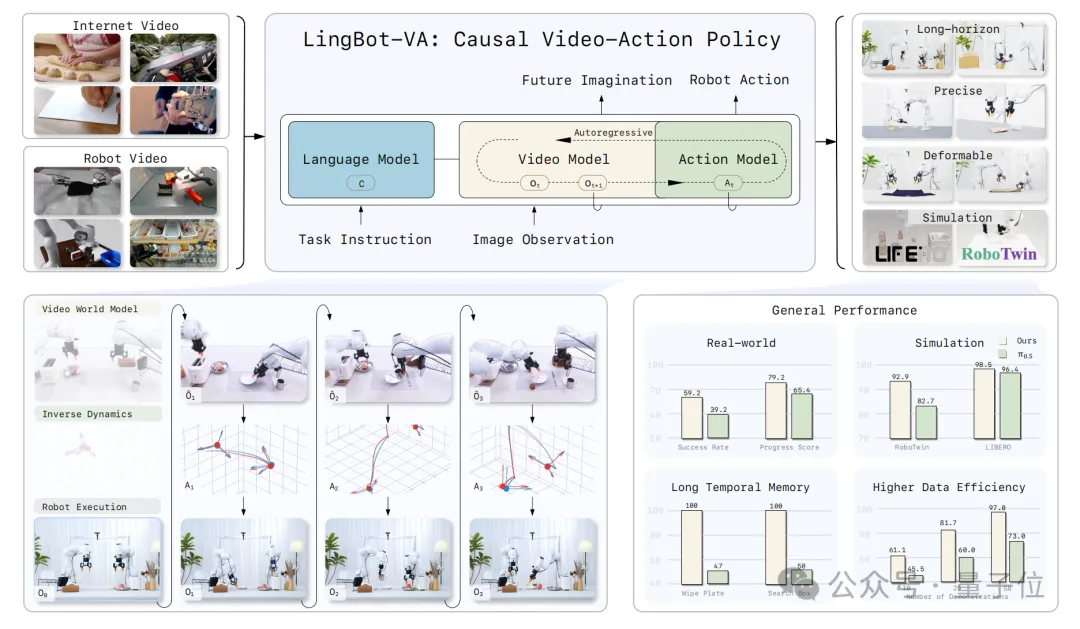

LingBot-VA在架构设计上选择了一条更进一步的路径。

在传统的VLA(视觉-语言-动作)范式中,模型通常会将视觉理解、物理变化推理、低层动作控制这三项复杂任务放在同一个神经网络中处理,这在学术界被称为表征缠绕(Representation Entanglement)。

为了追求更高的样本效率和更强的泛化能力,LingBot-VA选择把这团乱麻解开,提出了一套全新的解题思路:先想象世界,再反推动作。

为了实现这个想法,蚂蚁灵波团队采用了一个两步走的策略:

视频世界模型:先预测未来的视觉状态(接下来会发生什么)。逆向动力学(Inverse Dynamics):基于视觉的变化,反推出应该执行什么动作(为了达到这个画面,手该怎么动)。

这与传统VLA有着本质区别:它不直接从“现在”跳到“动作”,而是要经过一下“未来”这个步骤。

如何实现?蚂蚁灵波团队主要将三个架构层面作为突破口。

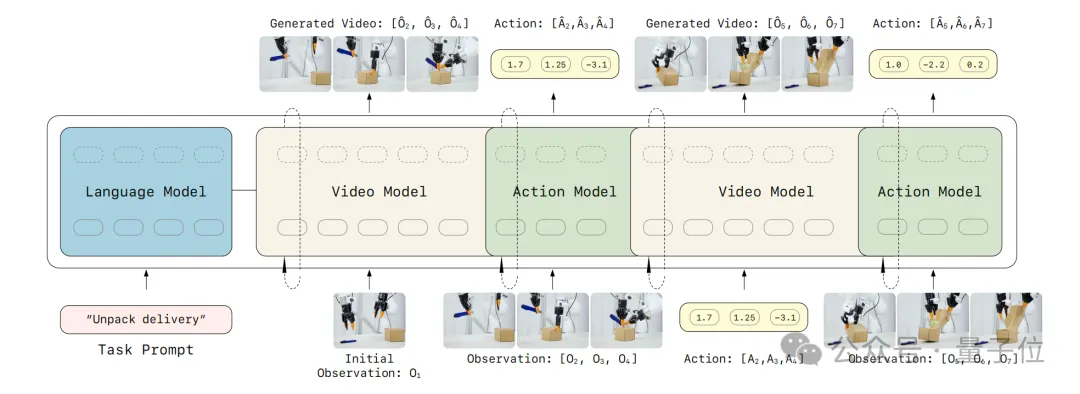

首先就是视频与动作的自回归交错序列。

在LingBot-VA的模型里,视频Token和动作Token被放进了同一条时间序列里。

为了保证逻辑严密,团队引入了因果注意力(Causal Attention)。这就像给模型定了一条死规矩:只能用过去的信息,绝对不能偷看未来。

同时,借助KV-cache技术,模型拥有了超强的长期记忆。它清楚地知道自己三步之前做了什么,任务绝对不会失忆。

其次是Mixture-of-Transformers (MoT) 的分工协作。

这一步主要是为了解决我们前面提到的表征缠绕的问题。

我们可以把过程理解为“左右互搏”,但又很默契的一种配合:

视频流:宽而深,负责繁重的视觉推演。动作流:轻而快,负责精准的运动控制。

这两个流共享注意力机制,信息互通,但在各自的表征空间里保持独立。

这样一来,视觉的复杂性不会干扰动作的精准度,动作的简单性也不会拉低视觉的丰富度。

最后就是工程设计相关的工作。

毕竟光有理论是不好使的,“实践才是检验真理的唯一标准”:

部分去噪(Partial Denoising):做动作预测时,其实不需要每一次都把未来画面渲染得高清无码。模型学会了从带有噪点的中间状态里提取关键信息,计算效率大大提升。异步推理(Asynchronous Inference):机器人在执行当前动作的时候,模型已经在后台疯狂计算下一步了。推理和执行并行,延迟感几乎消失。FDM 接地(Grounding):为了防止模型想象力脱离现实,系统会用真实的观测数据不断校正想象,避免出现开放式的幻觉漂移。实验结果与能力验证

在了解完理论之后,我们再来看实验效果。

蚂蚁灵波团队在真机实验和仿真基准上,对LingBot-VA进行了全方位的实测。

在真机测试中,LingBot-VA覆盖了三类最具挑战性的任务。

首先是长时序任务,比如准备早餐(烤面包、倒水、摆盘)、拆快递(拿刀、划箱、开盖)。

这些任务步骤繁多,但凡中间有一步有误,那可以说是满盘皆输。从LingBot-VA的表现来看,一个字,稳。

即便是不小心失败了,机器人也会记得进度,尝试重来。

第二类是高精度任务,比如擦试管、拧螺丝。

这要求动作精度达到毫米级,得益于MoT架构,动作流不再受视觉噪声的干扰,手极稳。

刚才我们已经看了擦拭管的案例,再来看个拧螺丝的:

第三类任务是针对可变形物体,例如折衣服、折裤子。

这些任务的难点在于物体处于一个随时变化的状态,但LingBot-VA通过视频推演,预判了布料的形变,操作行云流水。

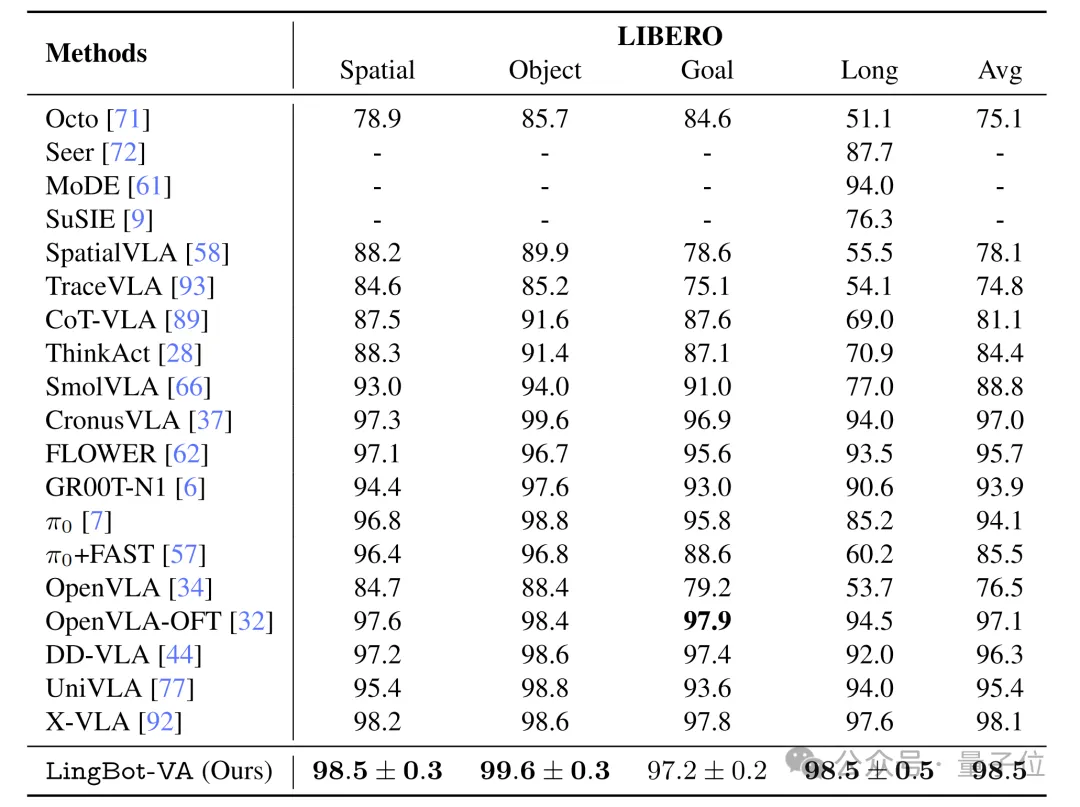

除此之外,LingBot-VA在RoboTwin 2.0和LIBERO这两个硬核仿真基准上,也是很能打的。

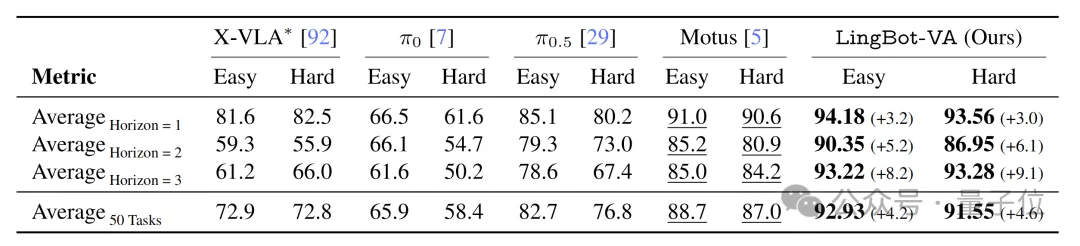

尤其是在RoboTwin 2.0的双臂协作任务中,无论是简单的固定场景(Easy),还是复杂的随机场景(Hard),LingBot-VA都展现出了不错的实力:

RoboTwin 2.0 (Easy):成功率92.93%,比第二名高出4.2%。

RoboTwin 2.0 (Hard):成功率91.55%,比第二名高出4.6%。

而且有一个趋势非常明显:

任务越难、序列越长(Horizon变大),LingBot-VA的领先优势就越大。

在 Horizon=3 的长任务中,它的优势甚至扩大到了9%以上。

而在LIBERO基准测试中,LingBot-VA更是拿下了98.5%的平均成功率,刷新了SOTA记录。