100根内存条换一套房:AI疯狂吞噬全球内存新智元

当巨头疯狂扫货、分析师开始囤iPhone17,你的钱包、电脑和AGI的未来,正在被同一堵看不见的墙悄悄卡住。

100根高容量服务器内存,总价已飙升至400万元!

一盒芯片相当于一套一线城市近郊的房产!

这疯狂一幕背后,是整个科技行业正在面临的一场史诗级危机。

2025年下半年以来,狂奔的AI行业并未如人们预期的那样因算力爆发而起飞,反而一头撞上了一堵看不见的墙——「内存墙」。

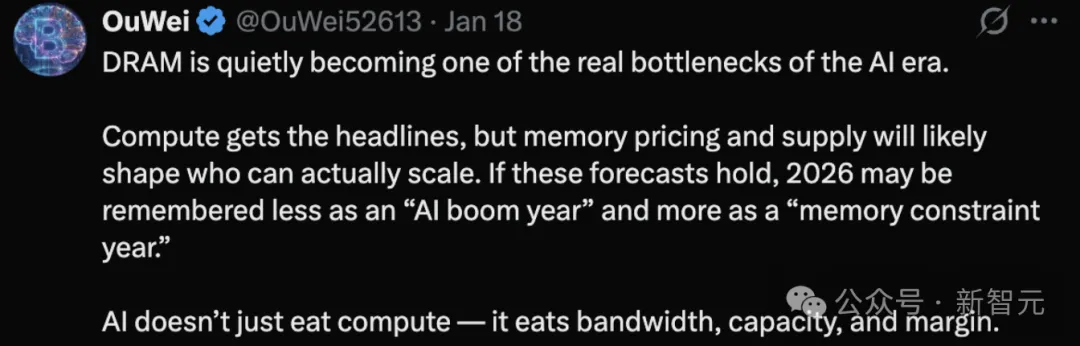

正如上面这位网友所言,2026年,可能不再是AI的「爆发之年」,而是「内存受限」之年:

2026年卡住AI脖子的,不再是我们熟知的算力或电力,而是内存容量与带宽。

这一判断并非危言耸听。

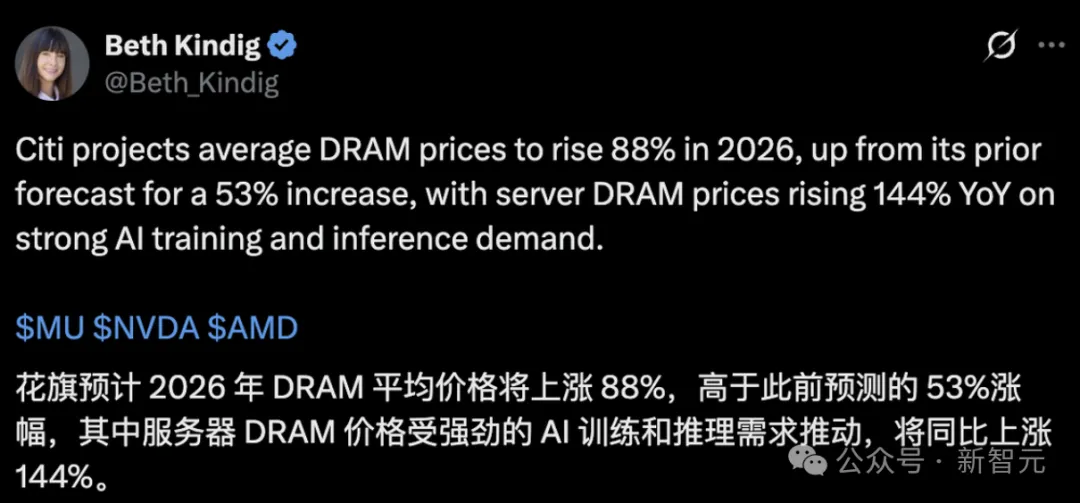

花旗银行的最新研报发出预警:2026年DRAM(动态随机存取存储器)平均售价同比或将上涨88%!

TechRadar近日的报道也佐证了这一趋势:受AI数据中心无底洞般的需求驱动,DRAM价格预计在2026年3月将接近翻倍。

为什么内存这么重要?

DRAM好比是CPU/GPU临时操作台,是临时「放数据、随取随用」的地方,模型越大,越需要更大容量、更高带宽的DRAM。

如今,AI正在疯狂吸干全球的内存产能。

数据显示,单台AI服务器的内存需求显著高于普通服务器,叠加HBM/高容量 DDR5的产能倾斜,将原本分配给PC、手机的产能大量「吸走」,直接导致消费级市场的供给枯竭。

当OpenAI、谷歌等巨头为了争夺通往AGI的门票,以「价格不设上限」的方式疯狂扫货,甚至提前锁死2026年产能时,代价最终转嫁到了普通消费者身上。

你想买的那台新电脑,价格不仅没降,反而越来越坚挺;

手机处理器虽然年年换代,但体验提升却越来越不明显;

爱折腾硬件的小伙伴突然发现,那两根不起眼的内存条,竟然快要买不起了……

「内存受限」四个字,不仅是悬在科技巨头头顶的达摩克利斯之剑,还在悄悄掏空普通消费者的钱包!

分析师囤货背后

一场全球性的「内存危机」

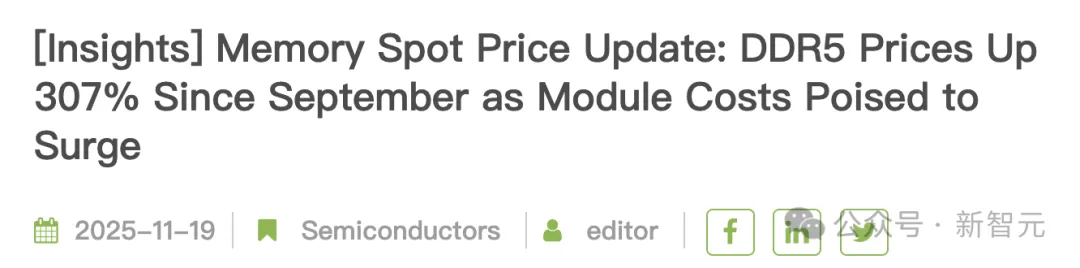

2025年下半年以来,存储芯片价格如同坐上火箭,内存、闪存价格全面翻倍。

据TrendForce数据显示,2025年9月以来,DDR5颗粒现货价累计上涨约307%,部分媒体走访称,顶配高容量服务器内存单条价格更是突破4万元。

这是什么概念?

手里捧着一盒100根的内存条(总价400万),你就相当于捧着一套北上广深近郊的房产!

与此对应的,是花旗银行Citi的研究部门已经大幅向上修正了他们预测:

2026年DRAM的价格将暴涨88%,而此前的预期仅为上涨53%。

如此恐怖的涨幅背后,是一场由AI巨头主导的、对全球存储资源的疯狂「抢夺」。

TechRadar报道称,服务器模组正在像黑洞一样,吞掉绝大部分晶圆产出。

原本留给PC、留给笔记本电脑的产能,被快速挤压得所剩无几。

TrendForce资深研究副总裁Avril Wu直接用钱包投票。

她告诉所有人:我一直跟大家说,如果你想买设备,现在就买。

甚至为了避险,她自己已经先买了一台iPhone17。

提前囤货一台iPhone17,这看起来有点微不足道,背后却是全球「内存告急」的信号。

全球存储巨头Micron传出的消息也不容乐观。

即便新的晶圆厂陆续投产,其CEO Sanjay Mehrotra也发出警告:目前只能满足客户需求的二分之一到三分之二。

这意味着,有接近一半的需求,拿着钱也买不到货。

PC端的供应商也开始挑客户,他们正在进行选择性配货,优先保障那些大型整机厂OEM,而压缩给第三方模组厂商的供货量。

这也就是为什么TechRadar预测,PC DRAM的合约价在2026年初可能会明显上调。

这不是简单的通胀,这是我们在为AI的发展,被迫缴纳的一笔昂贵的「资源税」。

被AI「吃掉」的内存

AI军备竞赛,让我们正在目睹科技史上最夸张的「剪刀差」。

根据加州大学伯克利分校一项有关「人工智能与内存墙」的论文研究提到:

由于前所未有的无监督训练数据规模,再加上Scaling laws(神经网络缩放定律),使得用于训练和在线服务大语言模型(LLM)的模型规模和算力需求出现了爆炸式增长。

研究人员指出,训练大模型所需的计算量最近以每两年750倍的速度增长,远超DRAM和互连带宽的增长速度——后者每两年仅分别增长1.6倍和1.4倍。

这种差距使得内存而非计算能力,成为AI应用(尤其是在推理场景中)的主要瓶颈。

过去20年里,人类芯片的算力峰值提升了整整60000倍。

但DRAM的带宽仅仅提升了约100倍,互连带宽增长约30倍。

这种极度的不匹配,将整个AI行业推入了一个「受限于内存」的死胡同。

科技咨询公司Greyhound Research的CEO Sanchit Vir Gogia打了个比方:AI的工作负载,本质上就是围绕内存来构建的。

这就好比你想用一根喝酸奶的细吸管,去吸干整个太平洋的水。

就算嘴巴(算力)再用力,水流(数据)也只有那么快,这种不匹配直接导致了一个极其昂贵的后果:空转。

那些数万美元一块的H100或者B200 GPU的算力巨兽,大部分时间只能「发呆」和「吃灰」。

因为数据传输跟不上,处理器经常处于闲置状态等待数据。

这就是典型的「内存墙」,而对于那些大模型公司来说,这无异于白白烧钱。

训练一个大模型,往往需要3到4倍于参数量的内存,数据搬运的速度远慢于计算速度,这直接主导了现代LLM的运行时间延迟。

所以,我们引以为傲的AI,其实一直戴着「内存受限」的镣铐在跳舞。

撞上「内存墙」

除了贵,还带来了什么瓶颈?

「内存墙」带给个体的感知,可能仅仅是显卡和电脑变贵,顶多是捂紧钱包,或者加紧囤货就好了。

但它带来的连锁反应,却成了困扰AI发展的瓶颈。