Transformer真的在做贝叶斯科研月野兔

论文标题:The Bayesian Geometry of Transformer Attention

论文地址:https://arxiv.org/pdf/2512.22471

首次提出可控的“Bayesian wind tunnels”评测框架:构造两类后验分布可解析、假设空间极大、记忆化不可行的合成任务(双射消除与隐马尔可夫状态追踪),把“模型是否做贝叶斯推理”转化为可逐位比对的熵校准误差,实现对小模型推理能力的量化验证。

发现注意力模式在训练早期即稳定,而值向量继续“展开”以提升后验精度,呈现“路由固定-数值精修”的解耦过程,与同期梯度动力学理论(本文系列论文 II)预测完全一致,首次在可控实验里实证该理论。

本文采用的核心研究方法是“贝叶斯风洞”实验范式:作者构造了两个假设空间巨大、记忆化不可行且后验分布有解析表达式的合成任务——双射消除与隐马尔可夫模型状态追踪——并在这些任务上训练参数量仅两三百万的小规模 Transformer 及容量匹配的 MLP 对照模型;通过逐位置比对模型预测熵与解析后验熵的校准误差,量化评估其贝叶斯推理能力,同时结合层间/头级消融、线性探针、Q-K 几何分析与值空间可视化等机制性诊断工具,揭示网络内部如何以几何形式实现绑定、消除与精修三段式贝叶斯更新过程。

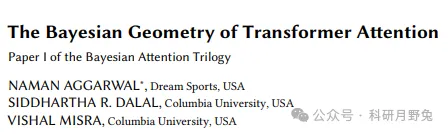

双射风洞熵校准对比图

本图显示在双射风洞任务中,Transformer 的逐位置预测熵曲线(蓝色)与解析贝叶斯后验熵(橙色)几乎完全重合,平均绝对误差仅 0.003 bit,而参数量相当的 MLP 的熵曲线几乎保持平坦,误差达 1.85 bit,直观证明 Transformer 能够精确执行逐步假设消除的贝叶斯推理,而 MLP 则完全失败。

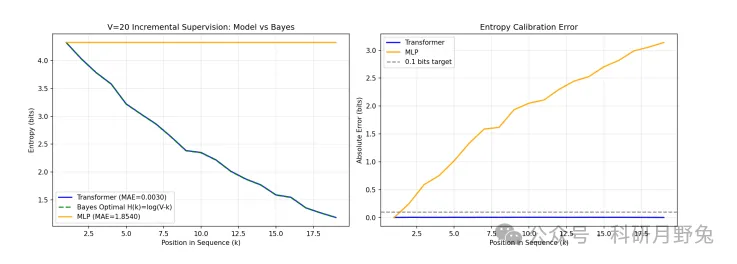

逐序列熵轨迹对比图

本图在双射风洞中随机抽取8条测试序列,将每条序列上模型输出的逐位置预测熵(实线)与对应解析贝叶斯后验熵(虚线)叠放展示,可以看到每一对曲线都同步呈现“阶梯式下降-突降至零”的锯齿形态:每当新映射被揭示时熵下降一位,若输入重复则熵瞬间归零;这种逐序列的精确同步说明Transformer并非在统计平均意义上拟合贝叶斯曲线,而是在单样本层面真实执行了逐步假设消除的贝叶斯更新过程。

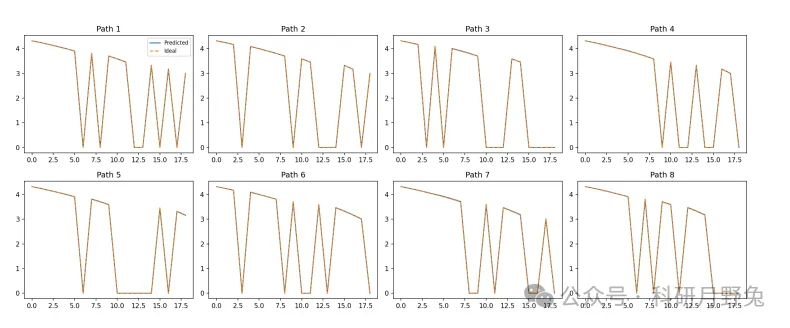

逐层消融熵误差图

本图展示了在双射风洞中对Transformer逐层(注意力+FFN)进行独立消融后的平均绝对熵误差:无论移除哪一层,校准误差都瞬间升高一个数量级以上,表明贝叶斯推理并非由某一层单独完成,而是依赖各层依次叠加、不可替代的组合式计算,从而证实深度结构对实现精确贝叶斯更新具有必要性。

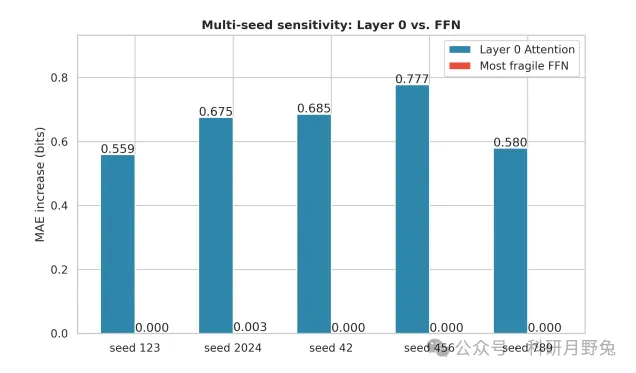

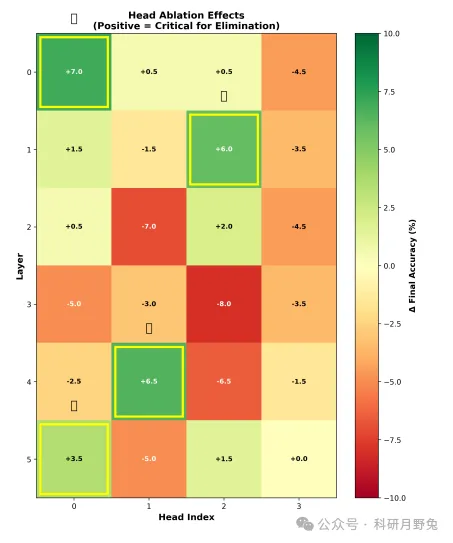

注意力头消融敏感性图

本图对双射模型中每个注意力头单独做消融,记录由此带来的平均绝对熵误差变化,结果显示Layer 0的一个特定头被移除时误差陡增,其余头影响相对小得多,说明该“假设框架头”承担了构建初始假设坐标系的关键角色,一旦缺失整个贝叶斯推理链路即被切断,从而从细粒度上验证了Layer 0负责奠基性绑定功能的结论。