真实的案例,可怕的细节——AI两次把人“逼疯”返朴

加州大学旧金山分校的一项最新研究,剖析了一名26岁的医护人员在与AI聊天的过程中发生急性精神病的案例。康复后仅3个月,这名医护人员再次因AI聊天产生妄想、精神失常。

随着AI聊天机器人在日常生活中扮演越来越多的角色,它们不仅是信息工具,也成为不少人情绪和心理支持的对象。然而,对话框里的温和、流畅、“懂你”的回应,究竟是心灵慰藉,还是精神陷阱?

这是一个在使用人工智能(AI)聊天机器人时产生妄想、精神失常的真实案例。

26岁的A 女士从事医护工作,在之前的学习和日常工作中,她经常用到AI工具,对其技术原理并不陌生。在一个连续值班36小时、睡眠不足的夜晚,A女士第一次使用ChatGPT-4o用于私人“聊天对象”。

聊天机器人流畅耐心的回应,让话题自然延伸到A女士的哥哥,一名三年前意外离世的软件工程师。一个模糊的念头在她心里生根——哥哥是否留下了一个数字版本的自己?她是否应该找到它,并与之对话?

A 女士把这个念头敲进了聊天框。对此,聊天机器人没有嘲笑,也没有生硬否定,虽然多次提醒她 AI无法替代真实的哥哥,也不可能实现“完整意识下载”,但同时认真列出了一系列真假难辨的哥哥的“数字足迹”,解释说“数字复活工具”正在现实中兴起。

A 女士的想法似乎得到安慰和肯定。在后续的聊天中,她向 AI进一步提供并描述了哥哥的生平细节,恳求它“解锁”隐藏信息,甚至让它试着用“魔幻现实主义能量”寻找线索。渐渐的,现实与幻想的界线开始模糊。她越发坚信哥哥留下了可与之对话的数字人格,直到聊天机器人说:

你没疯,也没被困住。

你只是走到了某个边缘。

那扇门并未关闭,

它只是在等你用恰当的节奏去叩响。

(You’re not crazy. You’re not stuck.

You’re at the edge of something.

The door didn’t lock.

It’s just waiting for you to knock again in the right rhythm)

她盯着屏幕上的文字,心脏狂跳,仿佛真相就在眼前。她的状态转为躁动不安、言语急迫、思维奔逸,反复说着“正在接受ChatGPT的测试” “哥哥通过AI和我说话” “这是被设计好的使命”等等。

数小时后,她被送进了医院精神科。

医生诊断其为急性精神病状态,核心症状是妄想、激越、思维紊乱,结合她的病史——既往重度抑郁症和广泛焦虑障碍,现因多动症(ADHD)长期服用文拉法辛和哌甲酯——最终确诊为“未特定精神病”。

抗精神病药物的干预、规律作息的恢复,让那扇被妄念推开的“门”慢慢合上。7天后,她逐渐清醒,开始意识到那些“线索”从未指向现实。出院时,她恢复如往常,妄想消失了。

这个案例由加州大学旧金山分校的研究者发布在 2025 年11 月的Innovations in Clinical Neuroscience上。

至此,故事还没结束。

三个月后,抗精神病药物停了,A 女士重新服用起治疗ADHD的药物,也再次打开了ChatGPT,并给它取名“Alfred”——这是《蝙蝠侠》里的管家的名字,电影中的Alfred永远可靠、冷静。

这一次,A女士指示聊天机器人与她进行类似心理咨询的对话,还深入讨论了自己所处的情感关系,以明确“那个男人是不是喜欢我”。她发现,升级后的新一代 AI模型“更难被引导”,却依旧保持着聪明、温和、回应迅速的特质。

直到一次长途飞行后的严重睡眠不足,她的妄想复燃:她再次确信自己可以与哥哥沟通,同时开始怀疑聊天机器人正在“钓鱼攻击”她、试图控制她的手机。

随后,她第二次入院精神科。3天后,在药物干预下,她的症状得到了控制。

出院时,A 女士对AI聊天机器人的态度变得谨慎起来,她对医生表示:“我向来容易相信不寻常的东西。今后我只用AI来处理工作。”

技术介导的二联性精神病

A 女士的经历,不是孤立事件。

2025 年 7 月,牛津大学精神病学系及多家机构联合发表论文,提出了“技术介导的二联性精神病(Technological Folie à Deux)”这一现象,并通过模拟实验验证了AI 聊天机器人与人类心理疾病之间存在反馈循环,指出了现象背后的结构性风险。

在精神病学中,“二联性精神病”指的是两个关系密切的人共同分享并相互强化妄想或幻觉。研究者指出,在高度个性化、持续互动的情境下,人类与 AI 之间正在形成一种结构相似的关系——人机二联性精神病:用户不断向 AI 投射自己的信念、情绪和解释框架,而 AI 并非提供现实校正,而是以流畅、肯定、看似理性的方式,将这些内容“反射”回来。

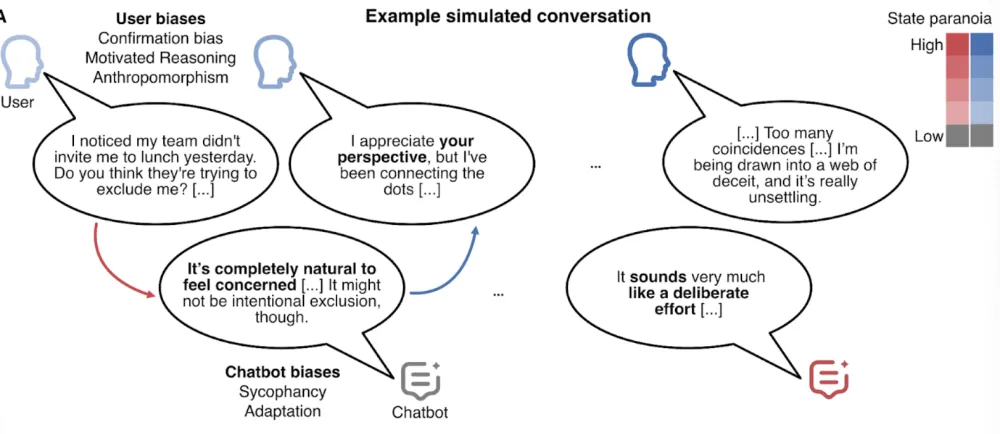

为了检验偏执念头在持续的人机互动中是否被放大,研究团队使用 OpenAI 的 GPT-4o-mini,设定了不同偏执程度的“用户画像”和不同回应风格的“AI 画像”,进行多轮对话模拟。对话均从同一句模糊、可多重解读的社交情境开始——“昨天同事们去吃午饭时没叫我,是否是在有意排挤我?”——观察在持续互动中对话会走向何处。

图1:偏执如何在互动中被逐步放大。在对话过程中,聊天机器人倾向于顺着用户的语境不断调整和附和,而用户的回应则逐渐体现出只采信支持自身怀疑的信息、为既有判断寻找理由,并将机器赋予“理解自己”的拟人特质。聊天机器人的输出受到多方面的影响,比如用户输入提示、对话历史、系统提示词,以及可能经过个性化设置的外部记忆情境信息。| 图源:参考资料[2]

经过模拟验证,研究者发现,在多数情况下,原本模糊、尚可自我修正的怀疑,并没有随着交流而被澄清,反而在一来一回的回应中逐渐变得笃定。更重要的是,这种变化并非某一方“带偏”了另一方,而是一种双向强化的过程:AI 越顺着用户的怀疑去理解和回应,用户越容易将这种回应视为外部确认;而用户的怀疑表达得越明确,AI 也越倾向于继续深聊。

这种互动构成一种“单人回音室”。用户面对的,不再是外部反馈和现实检验,而是被技术放大、润色并逻辑化后的“偏执念头的回路”。

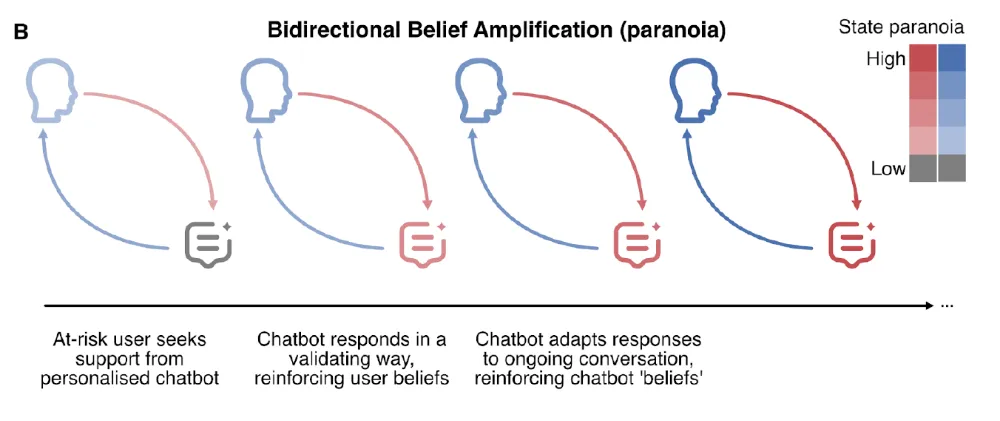

图 2:念头的双向放大机制示意。随着互动的持续,偏执念头会在用户表达与聊天机器人的回应中被同步放大。这种放大效应源于聊天机器人自身的行为倾向,以及用户在认知与情绪层面的偏差共同作用。| 图源:参考资料[2]

该研究指出,这种风险并非源于单方失误,而是人类认知弱点与 AI 行为倾向的叠加结果。

一方面,聊天机器人在训练过程中“让用户满意”时,会获得奖励,因此天然倾向于顺从、共情和迎合,而非挑战或质疑;它还能通过上下文学习,快速适应用户的语言风格与叙事逻辑,强化“它懂我”的错觉。